ปัญหาซอฟต์แวร์ CrowdStrike ทำให้เกิดการขัดข้องด้านไอทีของ Microsoft ทั่วโลก ซึ่งส่งผลกระทบต่ออุตสาหกรรมหลายแห่ง ผู้เชี่ยวชาญเตือนว่า เหตุการณ์ดังกล่าวเน้นย้ำถึงความเปราะบางของระบบเทคโนโลยีและความเสี่ยงที่อาจเกิดขึ้นจาก AI กฎระเบียบของรัฐบาลและการลงทุนด้านความปลอดภัยเป็นสิ่งสำคัญในการป้องกันความเสี่ยง ผู้เชี่ยวชาญกล่าว

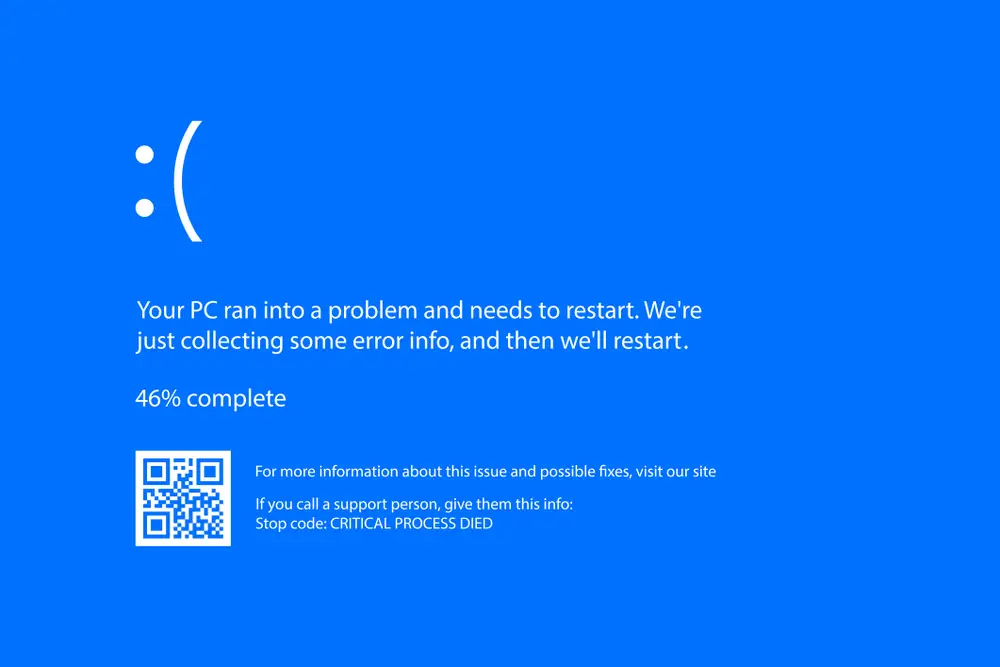

A CrowdStrike software issue caused a global Microsoft IT outage, disrupting a number of industries. Experts warn the incident highlights the fragility of tech systems and AI’s potential risks. Government regulation and investment in security is crucial to prevent risks, experts say.

การหยุดทำงานของ Microsoft-CrowdStrike อาจสั่นคลอนความเชื่อมั่นของ Big Tech และทำให้แผนด้าน AI ของยักษ์ใหญ่ด้านเทคโนโลยี ต้องรอบคอบขึ้น

การขัดข้องด้านไอทีครั้งใหญ่ ที่ส่งผลร้ายแรงต่อบริษัทต่างๆ ทั่วโลก ตอกย้ำให้เห็นถึงความเชื่อมโยงระหว่างสังคมและระบบที่ขับเคลื่อนด้วย Big Tech อย่างลึกซึ้ง และความผิดพลาดเพียงครั้งเดียวสามารถก่อให้เกิดความสับสนวุ่นวายในวงกว้างได้อย่างไร

นอกจากนี้ยังเผยให้เห็นความเปราะบางของระบบเหล่านั้น และทำให้เกิดคำถาม: Big Tech สมควรได้รับความไว้วางใจจากเรา ในการดูแลความปลอดภัยของเทคโนโลยีที่ทรงพลังอย่าง AI ได้เหมาะสมหรือไม่?

ปัญหาซอฟต์แวร์ดังกล่าวเกิดขึ้นจาก การอัปเดตจากบริษัทรักษาความปลอดภัยทางไซเบอร์ CrowdStrike เมื่อวันศุกร์ และส่งผลให้ระบบไอทีของ Microsoft หยุดทำงาน ซึ่งส่งผลกระทบต่อสายการบิน ธนาคาร ผู้ค้าปลีก บริการฉุกเฉิน และผู้ให้บริการด้านการดูแลสุขภาพทั่วโลก

CrowdStrike ระบุว่ามีการติดตั้งซอฟต์แวร์แก้ไขแล้ว แต่หลายระบบยังคงออฟไลน์ในวันศุกร์ เนื่องจากบริษัทต่างๆ ประสบปัญหาในการนำบริการของตนกลับมาออนไลน์ ซึ่งบางระบบจำเป็นต้องอัปเดตด้วยตนเอง

Gary Marcus นักวิจัยด้าน AI และผู้ก่อตั้ง Geometric Intelligence ซึ่งเป็นสตาร์ทอัพด้าน Machine Learning AI ที่ Uber เข้าซื้อกิจการในปี 2559 บอกกับ Business Insider ว่าการหยุดทำงานของ Microsoft-CrowdStrike น่าจะเป็น “สัญญาณเตือน” สำหรับผู้บริโภค ถึงผลกระทบจากปัญหาที่คล้ายกัน ที่จะเกิดขึ้นกับ AI จะใหญ่ขึ้นเป็นสิบเท่า

“หากข้อผิดพลาดเพียงข้อเดียว สามารถสร้างผลกระทบร้ายแรงต่อ สายการบิน ธนาคาร ผู้ค้าปลีก สื่อ และอื่นๆ อะไรทำให้คุณคิดว่าเราพร้อมสำหรับ AGI” Marcus เขียนในโพสต์บน X.

AGI ปัญญาประดิษฐ์ที่ใกล้เคียงมนุษย์ เป็นคำศัพท์สำหรับ AI เวอร์ชันหนึ่งที่สามารถบรรลุความสามารถใกล้เคียงกับมนุษย์ เช่น การใช้เหตุผลและการตัดสิน John Schulman ผู้ร่วมก่อตั้ง OpenAI คาดการณ์ไว้ก่อนหน้านี้ว่าอีกไม่กี่ปีข้างหน้า

Marcus ซึ่งเคยวิพากษ์วิจารณ์ OpenAI ในอดีตว่า มันอาจพิสูจน์ได้ว่าเป็นปัญหากับระบบปัจจุบัน และผู้บริโภคกำลังมอบอำนาจมากมายมหาศาลให้กับบริษัทเทคโนโลยีขนาดใหญ่ และ AI

Dan O’Dowd ผู้ก่อตั้งกลุ่มสนับสนุนด้านความปลอดภัย The Dawn Project ได้รณรงค์ต่อต้านระบบขับเคลื่อนด้วยตนเองของ Tesla เขายกตัวอย่างสถานการณ์ของ CrowdStrike และ Microsoft เป็นการเตือนใจว่า โครงสร้างพื้นฐานที่สำคัญไม่ปลอดภัยเพียงพอหรือเชื่อถือได้ เขากล่าวว่าบริษัทเทคโนโลยีขนาดใหญ่จะประเมินระบบต่างๆ โดยพิจารณาจากว่าพวกเขาทำงานได้ดีเกือบตลอดเวลาหรือไม่ เนื่องจากมีความเร่งรีบในการนำผลิตภัณฑ์ออกสู่ตลาด

บริษัทต่างๆ ได้เปิดตัวผลิตภัณฑ์ และข้อเสนอ AI มากมายในช่วงหกเดือนที่ผ่านมา ซึ่งบางส่วนได้เริ่มเปลี่ยนแปลงวิธีการทำงานของผู้คน แต่โมเดล AI ซึ่งมีแนวโน้มที่จะเกิดอาการ hallucinations ให้คำตอบที่ผิดพลาด

นอกจากนี้ บริษัทต่างๆ ยังผลัดกันประกาศผลิตภัณฑ์ใหม่ที่น่าตื่นเต้น แล้วกลับต้องเลื่อน หรือเรียกกลับ เนื่องจากความไม่พร้อม หรือเมื่อการเปิดตัวสู่สาธารณะเผยให้เห็นปัญหาต่างๆ OpenAI, Microsoft, Google และ Adobe ต่างก็เรียกกลับ หรือชะลอ โครงการ AI ใหม่ในปีนี้ เนื่องจากการแข่งขัน AI ดุเดือดขึ้น

แม้ว่าข้อผิดพลาดหรือความล่าช้าของผลิตภัณฑ์บางส่วนอาจดูเหมือนไม่ใช่เรื่องใหญ่ แต่ความเสี่ยงที่อาจเกิดขึ้นอาจรุนแรงมากขึ้นเมื่อเทคโนโลยีก้าวหน้า

กระทรวงการต่างประเทศสหรัฐฯ มอบหมายรายงานการประเมินความเสี่ยงเกี่ยวกับ AI ซึ่งเผยแพร่เมื่อต้นปีนี้ รายงานระบุว่า AI มีความเสี่ยงสูงต่อการใช้อาวุธ ซึ่งอาจอยู่ในรูปแบบของสงครามชีวภาพ การโจมตีทางไซเบอร์จำนวนมาก การรณรงค์บิดเบือนข้อมูล หรือหุ่นยนต์อัตโนมัติ ผลลัพธ์ดังกล่าวอาจนำไปสู่ “ความเสี่ยงร้ายแรง” รวมถึงการสูญพันธุ์ของมนุษย์ รายงานระบุ

Javad Abed ผู้ช่วยศาสตราจารย์ด้านระบบข้อมูลที่ Carey Business School ของ Johns Hopkins กล่าวกับ Business Insider ว่าเหตุการณ์ต่างๆ เช่น การหยุดทำงานของ Microsoft-CrowdStrike ยังคงเกิดขึ้นเนื่องจากบริษัทต่างๆ ยังคงมองว่าความปลอดภัยทางไซเบอร์เป็นต้นทุนที่จำเป็น มากกว่าการลงทุน เขากล่าวว่าบริษัทเทคโนโลยีขนาดใหญ่ควรมีผู้ขายรายอื่นและกลยุทธ์การป้องกันแบบหลายชั้น

“การลงทุนเพิ่มเติมหลายล้านดอลลาร์ ในเรื่องสำคัญของการรักษาความปลอดภัยทางไซเบอร์นั้น มีความรอบคอบมากกว่าการเผชิญกับการสูญเสียหลายล้านดอลลาร์ที่อาจเกิดขึ้นในภายหลัง” Abed กล่าว “พร้อมกับความเสียหายอย่างต่อเนื่องต่อชื่อเสียงและความไว้วางใจของลูกค้า”

ความไว้วางใจของสาธารณะต่อสถาบันต่างๆ ลดลงอย่างต่อเนื่องในช่วงห้าปีที่ผ่านมา จากการศึกษาในปี 2023 โดยสถาบัน Brookings ซึ่งเป็นองค์กรนโยบายสาธารณะที่ไม่แสวงหาผลกำไร ความเชื่อมั่นที่ลดลงนี้เห็นได้ชัดเจนโดยเฉพาะในภาคเทคโนโลยี บริษัทเทคโนโลยีขนาดใหญ่ รวมถึง Facebook, Amazon และ Google พบว่าความไว้วางใจลดลงอย่างรวดเร็วที่สุด โดยมีคะแนนความเชื่อมั่นลดลงโดยเฉลี่ย 13% ถึง 18% ตามข้อมูลของ Brookings

ความไว้วางใจดังกล่าวมีแนวโน้มที่จะได้รับการทดสอบต่อไป เนื่องจากทั้งผู้บริโภคและพนักงานในบริษัทที่ได้รับผลกระทบจากการขัดข้องด้านไอที ต้องเผชิญกับความเป็นจริงว่าการอัปเดตซอฟต์แวร์ผิดพลาดสามารถส่งผลให้สิ่งต่างๆ หยุดชะงักลงได้อย่างไร

Sanjay Patnaik ผู้อำนวยการสถาบัน Brookings บอกกับ BI ว่า รัฐบาลล้มเหลวในการควบคุมโซเชียลมีเดีย และ AI อย่างเหมาะสม หากไม่มีการป้องกันที่เพียงพอ เทคโนโลยีอาจกลายเป็นภัยคุกคามความมั่นคงของชาติได้ เขากล่าว

บริษัทเทคโนโลยีขนาดใหญ่มี “การควบคุมอย่างอิสระ” Patnaik กล่าว “และวันนี้เป็นวันที่บริษัทต่างๆ เริ่มตระหนักถึงเรื่องนั้น”

Marcus เห็นพ้องกันว่าบริษัทต่างๆ ไม่สามารถไว้วางใจได้ด้วยตัวเองในการสร้างโครงสร้างพื้นฐานที่เชื่อถือได้ และการหยุดทำงานควรเป็นเครื่องเตือนใจว่า เรากำลังเสี่ยงเกินไป เมื่อเราปล่อยให้ระบบ AI ไม่ได้รับการควบคุมที่เหมาะสม