Annapurna Labs ของกลุ่ม Big Tech กำลังทุ่มเงินจำนวนมากเพื่อสร้างชิปแบบกำหนดเองเพื่อลดการพึ่งพาผู้นำตลาด

Big Tech group’s Annapurna Labs is spending big to build custom chips that lessen its reliance on market leader

Amazon ยกระดับความพยายามสร้างชิป AI แข่งกับ Nvidia

Amazon เตรียมเปิดตัวชิปปัญญาประดิษฐ์รุ่นใหม่ในขณะที่กลุ่ม Big Tech มุ่งหวังผลตอบแทนจากการลงทุนหลายพันล้านดอลลาร์ในเซมิคอนดักเตอร์ และลดการพึ่งพาผู้นำตลาดอย่าง Nvidia

ผู้บริหารที่หน่วยประมวลผลระบบคลาวด์ของ Amazon กำลังทุ่มเงินจำนวนมากในชิปแบบกำหนดเองเพื่อหวังเพิ่มประสิทธิภาพในศูนย์ข้อมูลหลายสิบแห่ง ซึ่งจะช่วยลดต้นทุนของ Amazon เองรวมถึงของลูกค้าของ Amazon Web Services

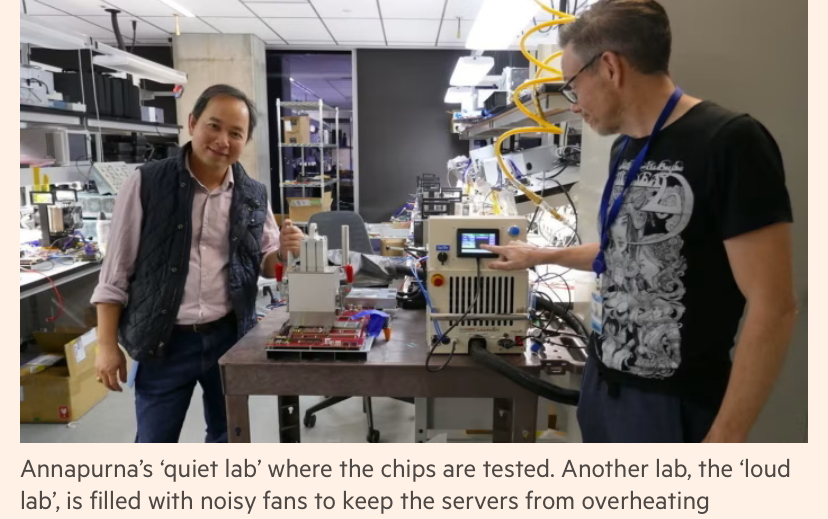

โครงการนี้นำโดย Annapurna Labs สตาร์ทอัพด้านชิปจากอิสราเอลที่ Amazon เข้าซื้อกิจการในช่วงต้นปี 2015 ด้วยมูลค่า 350 ล้านดอลลาร์ ซึ่งมีการดำเนินงานในออสติน

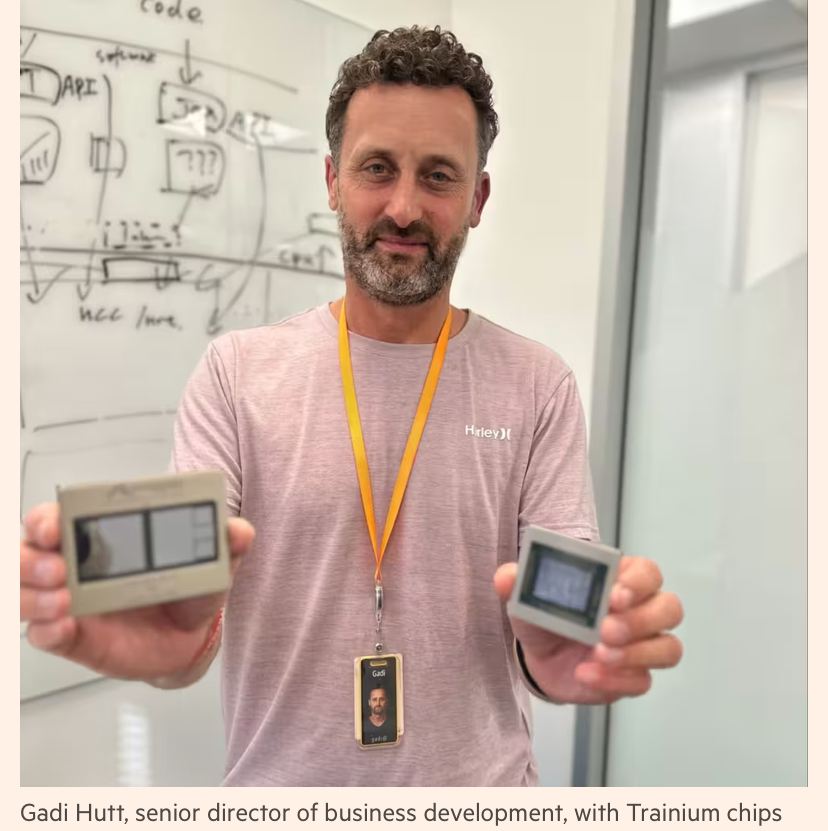

ผลงานล่าสุดของ Annapurna คาดว่าจะเปิดตัวในเดือนหน้าเมื่อ Amazon ประกาศให้บริการ Trainium 2 ซึ่งเป็นส่วนหนึ่งของชิป AI ที่ออกแบบมาเพื่อฝึกฝนโมเดลขนาดใหญ่

Trainium 2 กำลังถูกทดสอบโดย Anthropic — คู่แข่งของ OpenAI ที่ได้รับการสนับสนุนจาก Amazon จำนวน 4 พันล้านดอลลาร์ — รวมถึง Databricks, Deutsche Telekom, Ricoh และ Stockmark จากญี่ปุ่น

เป้าหมายของ AWS และ Annapurna คือการท้าทาย Nvidia ซึ่งเป็นหนึ่งในบริษัทที่มีมูลค่าสูงสุดของโลกจากการครอบครองตลาดโปรเซสเซอร์ AI

“เราต้องการเป็นสถานที่ที่ดีที่สุดในการใช้งาน Nvidia อย่างแน่นอน” Dave Brown รองประธานฝ่ายบริการประมวลผลและเครือข่ายของ AWS กล่าว “แต่ในขณะเดียวกันเราก็คิดว่ามันเป็นเรื่องดีที่จะมีทางเลือก” Amazon กล่าวว่าชิป AI เฉพาะทางอีกหนึ่งไลน์ที่ชื่อ Inferentia นั้นถูกกว่าในการใช้งานสำหรับการสร้างผลลัพธ์จากโมเดล AI ถึง 40 เปอร์เซ็นต์แล้ว

“ราคาของการประมวลผลคลาวด์มักจะสูงมากในด้านการเรียนรู้ของเครื่องและ AI” Brown กล่าว “เมื่อคุณประหยัดได้ 40 เปอร์เซ็นต์จาก 1,000 ดอลลาร์ มันอาจจะไม่ส่งผลมากนักต่อการตัดสินใจของคุณ แต่เมื่อคุณประหยัดได้ 40 เปอร์เซ็นต์จากเงินหลายสิบล้านดอลลาร์ มันมีผลมากทีเดียว”

ตอนนี้ Amazon คาดว่าจะใช้เงินลงทุนประมาณ 75 พันล้านดอลลาร์ในปี 2024 โดยส่วนใหญ่สำหรับโครงสร้างพื้นฐานด้านเทคโนโลยี ในการรายงานผลประกอบการล่าสุด Andy Jassy ประธานเจ้าหน้าที่บริหารกล่าวว่าเขาคาดว่าในปี 2025 บริษัทจะใช้จ่ายเพิ่มขึ้นอีก

นี่เป็นการเพิ่มขึ้นจากปี 2023 ซึ่งใช้จ่าย 48.4 พันล้านดอลลาร์ตลอดทั้งปี ผู้ให้บริการคลาวด์รายใหญ่ที่สุด รวมถึง Microsoft และ Google ต่างทุ่มเงินในการพัฒนา AI ที่แสดงให้เห็นว่าแนวโน้มนี้ยังไม่หยุด

Amazon, Microsoft และ Meta ต่างเป็นลูกค้ารายใหญ่ของ Nvidia แต่ก็กำลังออกแบบชิปศูนย์ข้อมูลของตนเองเพื่อวางรากฐานสำหรับสิ่งที่พวกเขาหวังว่าจะเป็นคลื่นการเติบโตของ AI

“ผู้ให้บริการคลาวด์รายใหญ่ทุกคนกำลังก้าวไปสู่ระบบ [เทคโนโลยีชิป] ที่มีความเฉพาะตัวมากขึ้น และหากเป็นไปได้ก็จะเป็นระบบที่รวมศูนย์และเป็นแบบเดียวกัน” Daniel Newman จาก The Futurum Group กล่าว

Newman ยังกล่าวว่า “ทุกคนตั้งแต่ OpenAI ถึง Apple กำลังมองหาวิธีสร้างชิปของตนเอง” โดยมีเป้าหมายเพื่อลดต้นทุนการผลิต เพิ่มกำไร มีความพร้อมใช้งานมากขึ้น และควบคุมได้มากขึ้น

“มันไม่ใช่ [แค่] เรื่องของชิป แต่มันเกี่ยวกับระบบทั้งหมด” Rami Sinno ผู้อำนวยการฝ่ายวิศวกรรมของ Annapurna และอดีตผู้บริหารของ SoftBank’s Arm และ Intel กล่าว

สำหรับโครงสร้างพื้นฐาน AI ของ Amazon นั่นหมายถึงการสร้างทุกอย่างตั้งแต่พื้นฐาน ตั้งแต่แผ่นเวเฟอร์ซิลิกอนไปจนถึงชั้นวางเซิร์ฟเวอร์ที่พวกเขาติดตั้ง โดยทุกอย่างได้รับการสนับสนุนโดยซอฟต์แวร์และสถาปัตยกรรมที่เป็นกรรมสิทธิ์ของ Amazon “สิ่งที่เราทำในระดับใหญ่เช่นนี้เป็นเรื่องยากจริงๆ มีไม่กี่บริษัทที่สามารถทำได้” Sinno กล่าว

หลังจากเริ่มต้นด้วยการสร้างชิปเพื่อความปลอดภัยสำหรับ AWS ที่ชื่อ Nitro Annapurna ได้พัฒนาชิปรุ่นต่างๆ ของ Graviton ซึ่งเป็นซีพียูแบบ Arm ที่ใช้พลังงานต่ำ ซึ่งเป็นทางเลือกสำหรับเซิร์ฟเวอร์แบบดั้งเดิมที่จัดหามาโดย Intel หรือ AMD

“ข้อได้เปรียบที่สำคัญสำหรับ AWS คือชิปของพวกเขาใช้พลังงานน้อยลง และศูนย์ข้อมูลของพวกเขาอาจมีประสิทธิภาพมากขึ้นเล็กน้อย” ซึ่งช่วยลดต้นทุน G Dan Hutcheson นักวิเคราะห์จาก TechInsights กล่าว หากหน่วยประมวลผลกราฟิกของ Nvidia เป็นเครื่องมือเอนกประสงค์ที่ทรงพลัง — เปรียบเหมือนรถยนต์แบบ station wagon หรือ estate car — Amazon สามารถปรับชิปของตนให้เหมาะสมกับงานและบริการเฉพาะ เช่น รถยนต์ compact หรือ hatchback เขากล่าว

อย่างไรก็ตาม AWS และ Annapurna ยังคงไม่สามารถทำลายการครองตลาดโครงสร้างพื้นฐาน AI ของ Nvidia ได้

Nvidia รายงานรายได้ 26.3 พันล้านดอลลาร์จากการขายชิป AI สำหรับศูนย์ข้อมูลในไตรมาสที่สองของปีงบประมาณ 2024 ตัวเลขดังกล่าวเท่ากับรายได้ของ Amazon จากทั้งแผนก AWS ในไตรมาสที่สองของปีงบประมาณ โดยมีเพียงส่วนเล็กๆ เท่านั้นที่สามารถนับรวมเป็นรายได้จากลูกค้าที่ใช้งาน AI บนโครงสร้างพื้นฐานของ Annapurna ตามที่ Hutcheson กล่าว

ในด้านประสิทธิภาพดิบของชิป AWS เมื่อเปรียบเทียบกับ Nvidia Amazon หลีกเลี่ยงการเปรียบเทียบโดยตรงและไม่ส่งชิปของตนเข้ารับการทดสอบประสิทธิภาพโดยหน่วยงานภายนอก

“การทดสอบ benchmark ดีสำหรับการตรวจสอบขั้นต้นว่า ‘ฉันควรพิจารณาชิปนี้ไหม?’” Patrick Moorhead ที่ปรึกษาด้านชิปจาก Moor Insights & Strategy กล่าว แต่การทดสอบจริงคือเมื่อชิปถูกนำไปใช้งานในหลายๆ ชั้นวางเป็นกลุ่ม

Moorhead กล่าวว่าเขามั่นใจว่าข้ออ้างของ Amazon เรื่องการเพิ่มประสิทธิภาพสี่เท่าระหว่าง Trainium 1 และ Trainium 2 นั้นเป็นเรื่องจริง เนื่องจากเขาได้ศึกษาบริษัทนี้มาหลายปี แต่ตัวเลขประสิทธิภาพอาจสำคัญน้อยกว่าการที่ Amazon มอบตัวเลือกให้ลูกค้าได้มากขึ้น

“ผู้คนชื่นชมทุกนวัตกรรมที่ Nvidia นำมา แต่ไม่มีใครสบายใจที่ Nvidia ครองตลาดถึง 90 เปอร์เซ็นต์” เขากล่าวเสริม “มันคงไม่สามารถเป็นเช่นนี้ได้นาน”