Sam Altman ซีอีโอของ OpenAI เชื่อว่าปัญญาประดิษฐ์ (AI) จะเปลี่ยนแปลงสังคมอย่างมีนัยสำคัญ แต่ก็ก่อให้เกิดความเสี่ยงที่สำคัญเช่นกัน เขาพูดถึงอันตรายของ AI เช่น ข้อมูลบิดเบือนขนาดใหญ่และการโจมตีทางไซเบอร์ที่น่ารังเกียจ และแสดงความกังวลเกี่ยวกับมนุษย์ที่อาจควบคุมเทคโนโลยี Altman ยืนยันว่า OpenAI ต้องการให้หน่วยงานกำกับดูแลและสังคมมีส่วนร่วมในการเปิดตัว ChatGPT ซึ่งเป็นโมเดลภาษา AI ที่สามารถเขียนโค้ดคอมพิวเตอร์ ทำคะแนนได้ดีในการทดสอบ และมีผู้ใช้งานมากกว่า 100 ล้านคนต่อเดือน อย่างไรก็ตาม เขายอมรับความท้าทายในการพัฒนา ChatGPT เช่น การหลีกเลี่ยงข้อมูลที่ไม่ถูกต้องตามข้อเท็จจริง ซึ่งโปรแกรมอาจสร้างขึ้น แม้จะมีการเกิดขึ้นของ AI แต่ Altman ก็หวังว่ามนุษย์จะสามารถควบคุมเทคโนโลยีได้ โดยใช้มันเพื่อปรับปรุงเศรษฐกิจและกลายเป็นเครื่องขยายความต้องการของมนุษย์

Sam Altman, CEO of OpenAI, believes that artificial intelligence (AI) will significantly alter society but also poses significant risks. He spoke of the dangers of AI, such as large-scale disinformation and offensive cyberattacks, and expressed concerns about the humans who may control the technology. Altman insisted that OpenAI needs regulators and society to be involved in the rollout of ChatGPT, an AI language model that can write computer code, score well on tests, and has already garnered over 100 million monthly active users. However, he acknowledged the challenges of developing ChatGPT, such as avoiding factually inaccurate information, which the program may generate. Despite the emergence of AI, Altman hopes that humans can remain in control of the technology, using it to enhance the economy and become an amplifier of human will.

Sam Altman CEO ของ OpenAI กล่าวว่า AI จะเปลี่ยนโฉมสังคมใหม่ โดยยอมรับความเสี่ยงและ: ‘กลัวสิ่งนี้นิดหน่อย’

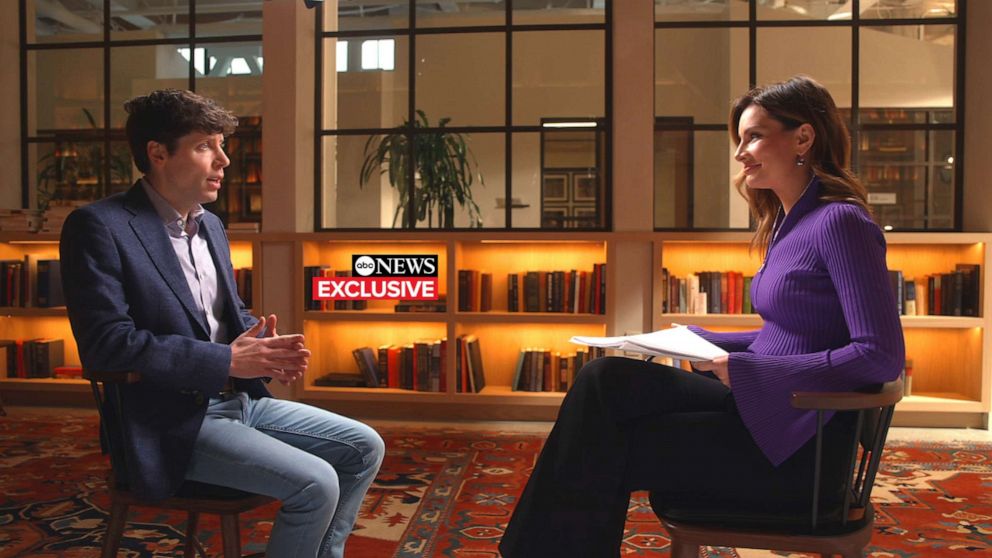

CEO ที่อยู่เบื้องหลังบริษัทที่สร้าง ChatGPT เชื่อว่าเทคโนโลยีปัญญาประดิษฐ์จะพลิกโฉมสังคมอย่างที่เรารู้จัก เขาเชื่อว่ามันมาพร้อมกับอันตรายที่แท้จริง แต่ยังสามารถเป็น “เทคโนโลยีที่ยิ่งใหญ่ที่สุดที่มนุษยชาติยังพัฒนาอยู่” เพื่อพัฒนาชีวิตของเราอย่างมาก “เราต้องระวังที่นี่” Sam Altman ซีอีโอของ OpenAI กล่าว “ผมคิดว่าผู้คนควรมีความสุขที่เรากลัวเรื่องนี้เล็กน้อย” Altman นั่งลงเพื่อสัมภาษณ์พิเศษกับ Rebecca Jarvis ผู้สื่อข่าวสายธุรกิจ เทคโนโลยี และเศรษฐศาสตร์ของ ABC News เพื่อพูดคุยเกี่ยวกับการเปิดตัว GPT-4 ซึ่งเป็นโมเดลภาษา AI ที่ทำซ้ำล่าสุด

ในการสัมภาษณ์ของเขา Altman เน้นย้ำว่า OpenAI ต้องการให้ทั้งหน่วยงานกำกับดูแลและสังคมมีส่วนร่วมมากที่สุดเท่าที่จะเป็นไปได้ด้วยการเปิดตัว ChatGPT โดยยืนยันว่าความคิดเห็นจะช่วยยับยั้งผลกระทบด้านลบที่เทคโนโลยีอาจมีต่อมนุษยชาติ เขาเสริมว่าเขาอยู่ใน “การติดต่อเป็นประจำ” กับเจ้าหน้าที่ของรัฐ

ChatGPT เป็นโมเดลภาษา AI GPT ย่อมาจาก Generative Pre-trained Transformer เปิดตัวเมื่อไม่กี่เดือนที่ผ่านมา ถือเป็นแอปพลิเคชันสำหรับผู้บริโภคที่เติบโตเร็วที่สุดในประวัติศาสตร์ แอปนี้มีผู้ใช้งานถึง 100 ล้านรายต่อเดือนในเวลาเพียงไม่กี่เดือน จากการศึกษาของ UBS พบว่า TikTok ใช้เวลาเก้าเดือนในการเข้าถึงผู้ใช้จำนวนมากและ Instagram ใช้เวลาเกือบสามปี

แม้ว่าจะ “ไม่สมบูรณ์แบบ” ตามคำกล่าวของ Altman แต่ GPT-4 ก็ได้คะแนนในเปอร์เซ็นไทล์ที่ 90 ในการสอบ Uniform Bar นอกจากนี้ยังได้คะแนนเกือบสมบูรณ์แบบในการทดสอบ SAT Math และตอนนี้สามารถเขียนโค้ดคอมพิวเตอร์ในภาษาโปรแกรมส่วนใหญ่ได้อย่างเชี่ยวชาญ

GPT-4 เป็นเพียงก้าวหนึ่งสู่เป้าหมายของ OpenAI ในการสร้างปัญญาประดิษฐ์ทั่วไปในที่สุด ซึ่งเป็นเวลาที่ AI ก้าวข้ามขีดจำกัดอันทรงพลังซึ่งอาจอธิบายได้ว่าเป็นระบบ AI ที่โดยทั่วไปฉลาดกว่ามนุษย์ แม้ว่าเขาจะฉลองความสำเร็จของผลิตภัณฑ์ของเขา แต่ Altman ก็ยอมรับการใช้งาน AI ที่อาจเป็นอันตรายได้ซึ่งทำให้เขานอนไม่หลับในตอนกลางคืน

“ผมกังวลเป็นพิเศษว่าโมเดลเหล่านี้อาจถูกใช้สำหรับการบิดเบือนข้อมูลจำนวนมาก” อัลท์แมนกล่าว “ตอนนี้พวกเขาเริ่มเขียนโค้ดคอมพิวเตอร์ได้ดีขึ้น [พวกเขา] สามารถใช้สำหรับการโจมตีทางไซเบอร์ที่ไม่เหมาะสมได้” ความกลัวทั่วไปในแนวไซไฟที่ Altman ไม่มีเหมือนกัน: โมเดล AI ที่ไม่ต้องการมนุษย์ ที่ตัดสินใจได้เองและวางแผนการครอบครองโลก “มันกำลังรอให้ใครสักคนให้ข้อมูล” Altman กล่าว “นี่เป็นเครื่องมือที่อยู่ในการควบคุมของมนุษย์เป็นอย่างมาก”

อย่างไรก็ตาม เขาบอกว่าเขากลัวที่มนุษย์สามารถควบคุมได้ “จะมีคนอื่นที่ไม่กำหนดขีดจำกัดความปลอดภัยบางอย่างที่เรากำหนดไว้” เขากล่าวเสริม “ผมคิดว่าสังคมมีเวลาจำกัดในการค้นหาว่าจะตอบสนองต่อสิ่งนั้นอย่างไร จะควบคุมอย่างไร และจะจัดการกับมันอย่างไร” ประธานาธิบดีวลาดิมีร์ ปูติน อ้างคำกล่าวที่บอกกับนักเรียนชาวรัสเซียในวันเปิดเทอมวันแรกในปี 2560 ว่า ใครก็ตามที่เป็นผู้นำการแข่งขัน AI มีแนวโน้มที่จะ “ครองโลก”

“นั่นเป็นคำพูดที่เยือกเย็นอย่างแน่นอน” Altman กล่าว “สิ่งที่ผมหวังคือ เราพัฒนาระบบที่ทรงพลังมากขึ้นเรื่อยๆ อย่างต่อเนื่อง ซึ่งเราทุกคนสามารถใช้ในรูปแบบต่างๆ ที่รวมเข้ากับชีวิตประจำวันของเรา ในระบบเศรษฐกิจ และกลายเป็นเครื่องขยายความประสงค์ของมนุษย์”

ความกังวลเกี่ยวกับข้อมูลที่ผิด

จากข้อมูลของ OpenAI GPT-4 มีการปรับปรุงอย่างมากจากการทำซ้ำครั้งก่อน รวมถึงความสามารถในการเข้าใจรูปภาพที่เป็นอินพุต การสาธิตแสดง GTP-4 ที่อธิบายสิ่งที่อยู่ในตู้เย็นของใครบางคน ไขปริศนา และแม้แต่อธิบายความหมายเบื้องหลังมีมบนอินเทอร์เน็ต ขณะนี้คุณลักษณะนี้สามารถเข้าถึงได้โดยผู้ใช้กลุ่มเล็กๆ เท่านั้น ซึ่งรวมถึงกลุ่มผู้ใช้ที่มีความบกพร่องทางสายตาซึ่งเป็นส่วนหนึ่งของการทดสอบเบต้า แต่ปัญหาที่สอดคล้องกับโมเดลภาษา AI เช่น ChatGPT อ้างอิงจาก Altman คือข้อมูลที่ผิด: โปรแกรมสามารถให้ข้อมูลที่ไม่ถูกต้องตามความเป็นจริงแก่ผู้ใช้

“สิ่งที่ผมพยายามเตือนผู้คนมากที่สุดคือสิ่งที่เราเรียกว่า ‘ปัญหาภาพหลอน’” อัลท์แมนกล่าว “แบบจำลองจะระบุสิ่งต่าง ๆ อย่างมั่นใจราวกับว่าข้อเท็จจริงเหล่านั้นถูกสร้างขึ้นมาทั้งหมด”

โมเดลมีปัญหานี้ ส่วนหนึ่งเป็นเพราะใช้เหตุผลแบบนิรนัยมากกว่าการท่องจำ ตามข้อมูลของ OpenAI “หนึ่งในความแตกต่างที่ใหญ่ที่สุดที่เราเห็นจาก GPT-3.5 ถึง GPT-4 คือความสามารถในการให้เหตุผลที่ดีขึ้น” Mira Murati ประธานเจ้าหน้าที่ฝ่ายเทคโนโลยีของ OpenAI กล่าวกับ ABC News “เป้าหมายคือการทำนายคำถัดไป และด้วยเหตุนี้ เราจึงเห็นว่ามีความเข้าใจในภาษานี้” มูราติกล่าว “เราต้องการให้นางแบบเหล่านี้มองเห็นและเข้าใจโลกมากขึ้นเหมือนที่เราทำ”

Altman กล่าวว่า “วิธีที่ถูกต้องในการคิดโมเดลที่เราสร้างขึ้นคือเครื่องมือสร้างเหตุผล ไม่ใช่ฐานข้อมูลข้อเท็จจริง” “พวกเขายังสามารถทำหน้าที่เป็นฐานข้อมูลข้อเท็จจริงได้ แต่นั่นไม่ใช่สิ่งที่พิเศษเกี่ยวกับพวกเขา สิ่งที่เราต้องการให้พวกเขาทำคือสิ่งที่ใกล้เคียงกับความสามารถในการใช้เหตุผล ไม่ใช่การท่องจำ”

Altman และทีมงานของเขาหวังว่า “โมเดลจะกลายเป็นเครื่องมือให้เหตุผลนี้เมื่อเวลาผ่านไป” เขากล่าว ในที่สุดก็สามารถใช้อินเทอร์เน็ตและการใช้เหตุผลแบบนิรนัยเพื่อแยกข้อเท็จจริงออกจากเรื่องแต่ง GPT-4 มีแนวโน้มที่จะให้ข้อมูลที่แม่นยำมากกว่าเวอร์ชันก่อนหน้าถึง 40% ตามข้อมูลของ OpenAI ถึงกระนั้น Altman กล่าวว่าการใช้ระบบเป็นแหล่งข้อมูลหลักที่ถูกต้อง “เป็นสิ่งที่คุณไม่ควรใช้” และสนับสนุนให้ผู้ใช้ตรวจสอบผลลัพธ์ของโปรแกรมอีกครั้ง

ข้อควรระวังกับผู้ประพฤติไม่ดี

ประเภทของข้อมูล ChatGPT และโมเดลภาษา AI อื่นๆ ก็เป็นประเด็นที่น่ากังวลเช่นกัน ตัวอย่างเช่น ChatGPT สามารถบอกผู้ใช้ถึงวิธีการสร้างระเบิดได้หรือไม่ คำตอบคือไม่ ตาม Altman เนื่องจากมาตรการความปลอดภัยที่เข้ารหัสใน ChatGPT “สิ่งที่ผมกังวลคือ … เราจะไม่เป็นเพียงผู้สร้างเทคโนโลยีนี้” Altman กล่าว “จะมีคนอื่นที่ไม่ได้กำหนดขีดจำกัดความปลอดภัยบางอย่างที่เรากำหนดไว้” มีวิธีแก้ไขและป้องกันอันตรายที่อาจเกิดขึ้นทั้งหมดเหล่านี้ด้วย AI เล็กน้อย

อ้างอิงจาก Altman หนึ่งในนั้น: ให้สังคมได้เล่น ChatGPT ในขณะที่เดิมพันต่ำ และเรียนรู้จากวิธีที่ผู้คนใช้ ขณะนี้ ChatGPT เปิดให้บริการแก่สาธารณะเป็นหลักเนื่องจาก “เรากำลังรวบรวมข้อเสนอแนะจำนวนมาก” ตาม Murati ขณะที่สาธารณชนยังคงทดสอบแอปพลิเคชันของ OpenAI อย่างต่อเนื่อง Murati กล่าวว่าการระบุจุดที่ต้องการการป้องกันจะง่ายขึ้น

“ผู้คนใช้มันเพื่ออะไร แต่ยังรวมถึงปัญหาที่เกิดขึ้น อะไรคือข้อเสีย และความสามารถในการก้าวเข้ามา [และ] ปรับปรุงเทคโนโลยี” Murati กล่าว Altman กล่าวว่า สิ่งสำคัญคือประชาชนจะต้องมีปฏิสัมพันธ์กับ ChatGPT แต่ละเวอร์ชัน

“ถ้าเราพัฒนาสิ่งนี้อย่างลับๆ ในแล็บเล็กๆ ของเราที่นี่ และสร้าง GPT-7 แล้วทิ้งมันลงบนโลกในคราวเดียว ผมคิดว่าเป็นสถานการณ์ที่มีข้อเสียมากกว่า” อัลท์แมนกล่าว “ผู้คนต้องการเวลาในการอัปเดต ตอบสนอง เพื่อทำความคุ้นเคยกับเทคโนโลยีนี้ [และ] เพื่อทำความเข้าใจว่าจุดด้อยอยู่ที่ไหนและอะไรที่สามารถบรรเทาได้”

เกี่ยวกับเนื้อหาที่ผิดกฎหมายหรือขัดต่อศีลธรรม Altman กล่าวว่าพวกเขามีทีมผู้กำหนดนโยบายที่ OpenAI ซึ่งเป็นผู้ตัดสินใจว่าข้อมูลใดที่จะเข้าสู่ ChatGPT และ ChatGPT ที่ได้รับอนุญาตให้แบ่งปันกับผู้ใช้

“[เรากำลัง] พูดคุยกับผู้เชี่ยวชาญด้านนโยบายและความปลอดภัยต่างๆ รับการตรวจสอบระบบเพื่อพยายามแก้ไขปัญหาเหล่านี้และนำสิ่งที่เราคิดว่าปลอดภัยและดีออกมา” Altman กล่าวเสริม “และอีกครั้ง เราจะไม่ทำให้มันสมบูรณ์แบบในครั้งแรก แต่สิ่งสำคัญคือต้องเรียนรู้บทเรียนและหาจุดได้เปรียบในขณะที่เดิมพันค่อนข้างต่ำ”

AI จะเข้ามาแทนที่งานหรือไม่?

ท่ามกลางข้อกังวลเกี่ยวกับความสามารถในการทำลายล้างของเทคโนโลยีนี้คือการแทนที่งาน Altman กล่าวว่าสิ่งนี้น่าจะเข้ามาแทนที่งานบางอย่างในอนาคตอันใกล้ และกังวลว่าจะเกิดขึ้นเร็วแค่ไหน

“ผมคิดว่าในช่วงสองสามชั่วอายุคน มนุษยชาติได้พิสูจน์แล้วว่าสามารถปรับตัวให้เข้ากับการเปลี่ยนแปลงทางเทคโนโลยีครั้งใหญ่ได้อย่างยอดเยี่ยม” อัลท์แมนกล่าว “แต่ถ้าสิ่งนี้เกิดขึ้นในจำนวนปีที่มีเลขหลักเดียว การเปลี่ยนแปลงบางอย่างเหล่านี้ … นั่นคือส่วนที่ฉันกังวลมากที่สุด”

แต่เขาสนับสนุนให้ผู้คนมองว่า ChatGPT เป็นเครื่องมือมากกว่า ไม่ใช่สิ่งทดแทน เขาเสริมว่า “ความคิดสร้างสรรค์ของมนุษย์นั้นไร้ขีดจำกัด และเราหางานใหม่ เราพบสิ่งใหม่ๆ ที่จะทำ”

Altman กล่าวว่าวิธีที่ ChatGPT สามารถใช้เป็นเครื่องมือสำหรับมนุษยชาตินั้นมีมากกว่าความเสี่ยง Altman กล่าวว่า “เราทุกคนสามารถมีนักการศึกษาที่น่าทึ่งซึ่งปรับแต่งมาเพื่อเรา ซึ่งช่วยให้เราเรียนรู้ได้” “เราสามารถมีคำแนะนำทางการแพทย์สำหรับทุกคนซึ่งเกินกว่าที่เราจะได้รับในปัจจุบัน”

ChatGPT เป็น ‘นักบินร่วม’

ในด้านการศึกษา ChatGPT กลายเป็นข้อถกเถียง เนื่องจากนักเรียนบางคนใช้ ChatGPT เพื่อโกงการบ้าน นักการศึกษาลังเลว่าสิ่งนี้สามารถใช้เป็นส่วนเสริมของตนเองหรือหากขัดขวางแรงจูงใจของนักเรียนที่จะเรียนรู้ด้วยตนเอง

“การศึกษาจะต้องเปลี่ยนแปลง แต่มันก็เกิดขึ้นหลายครั้งด้วยเทคโนโลยี” อัลท์แมนกล่าว พร้อมเสริมว่านักเรียนจะสามารถมีครูประเภทที่นอกเหนือไปจากห้องเรียนได้ “สิ่งหนึ่งที่ฉันตื่นเต้นที่สุดคือความสามารถในการให้การเรียนรู้รายบุคคล — การเรียนรู้รายบุคคลที่ยอดเยี่ยมสำหรับนักเรียนแต่ละคน”

ในทุกด้าน Altman และทีมของเขาต้องการให้ผู้ใช้คิดว่า ChatGPT เป็น “นักบินร่วม” ซึ่งเป็นคนที่สามารถช่วยคุณเขียนโค้ดคอมพิวเตอร์หรือแก้ปัญหาได้มากมาย

“เราสามารถมีได้สำหรับทุกอาชีพ และเราสามารถมีคุณภาพชีวิตที่สูงขึ้นมาก เช่น มาตรฐานการครองชีพ” Altman กล่าว “แต่เรายังสามารถมีสิ่งใหม่ๆ ที่เราไม่สามารถจินตนาการได้ในวันนี้ นั่นคือคำมั่นสัญญา”