ความก้าวหน้าของเทคโนโลยีปัญญาประดิษฐ์ (AI) ทำให้การสร้างวิดีโอ Deepfake ง่ายขึ้นและถูกลง ด้วยเครื่องมือมากมายที่มีให้สำหรับผู้บริโภคทั่วไป ซึ่งมักมีค่าใช้จ่ายเพียงเล็กน้อยหรือไม่มีเลย สิ่งนี้นำไปสู่วิดีโอปลอมจำนวนมากขึ้นบนเว็บไซต์โซเชียลมีเดียเช่น TikTok และ Twitter ด้วยเนื้อหาที่สร้างขึ้นโดยใช้เสียงคนดังที่ลอกเลียนแบบ การขยับปากที่เปลี่ยนแปลงเพื่อให้ตรงกับเสียงทางเลือก และบทสนทนาที่โน้มน้าวใจ นักวิจัยได้บัญญัติศัพท์คำว่า “cheapfakes” เพื่ออธิบายถึงประเภทใหม่ของวิดีโอที่ถูกบิดเบือน และได้แสดงความกังวลใหม่เกี่ยวกับอันตรายที่เกิดขึ้นและบริษัทสื่อสังคมออนไลน์พร้อมที่จะดูแลการปลอมแปลงที่เพิ่มขึ้นหรือไม่

Advances in artificial intelligence (AI) technology have made it easier and cheaper to create deepfake videos, with many of the tools now available to everyday consumers, often for little or no cost. This has led to a growing number of fake videos on social media sites such as TikTok and Twitter, with the content created using cloned celebrity voices, altered mouth movements to match alternative audio, and persuasive dialogue. Researchers have coined the term “cheapfakes” to describe the new genre of manipulated videos, and have raised fresh concerns about the dangers they pose and whether social media companies are prepared to moderate the growing fakery.

Deepfakes ถูกลงและง่ายขึ้นด้วย A.I.

โจ โรแกน นักแสดงตลกที่ผันตัวมาเป็นผู้จัดรายการพอดคาสต์ คงไม่ถือเป็นเรื่องเสียมารยาทไปเสียทีเดียวสำหรับการรับรองแบรนด์กาแฟที่ “กระตุ้นความใคร่” สำหรับผู้ชาย

แต่เมื่อวิดีโอที่เผยแพร่บน TikTok เมื่อเร็ว ๆ นี้แสดงให้เห็นว่าคุณโรแกนและแขกรับเชิญของเขา แอนดรูว์ ฮูเบอร์แมนกำลังดื่มกาแฟ ผู้ชมที่มีตาเหยี่ยวบางคนตกใจ รวมถึงดร. ฮูเบอร์แมนด้วย

“ใช่ นั่นเป็นของปลอม” ดร. ฮูเบอร์แมนเขียนบนทวิตเตอร์หลังจากเห็นโฆษณา ซึ่งดูเหมือนจะยกย่องศักยภาพในการกระตุ้นฮอร์โมนเทสโทสเตอโรนของกาแฟ แม้ว่าเขาจะไม่เคยทำก็ตาม

AI. ของปลอม

โฆษณาบน TikTok รวมวิดีโอจริงของ Andrew Huberman เข้ากับเสียงของ Joe Rogan ในเวอร์ชันดัดแปลงที่ผู้เชี่ยวชาญกล่าวว่าน่าจะสร้างขึ้นด้วยปัญญาประดิษฐ์

โฆษณาดังกล่าวเป็นหนึ่งในวิดีโอปลอมจำนวนมากขึ้นบนโซเชียลมีเดียที่สร้างด้วยเทคโนโลยีที่ขับเคลื่อนโดยปัญญาประดิษฐ์ ผู้เชี่ยวชาญกล่าวว่าเสียงของ Mr. Rogan นั้นถูกสังเคราะห์ขึ้นโดยใช้ A.I. เครื่องมือเลียนแบบเสียงคนดัง ความคิดเห็นของ Dr. Huberman ถูกคัดลอกมาจากการสัมภาษณ์ที่ไม่เกี่ยวข้อง

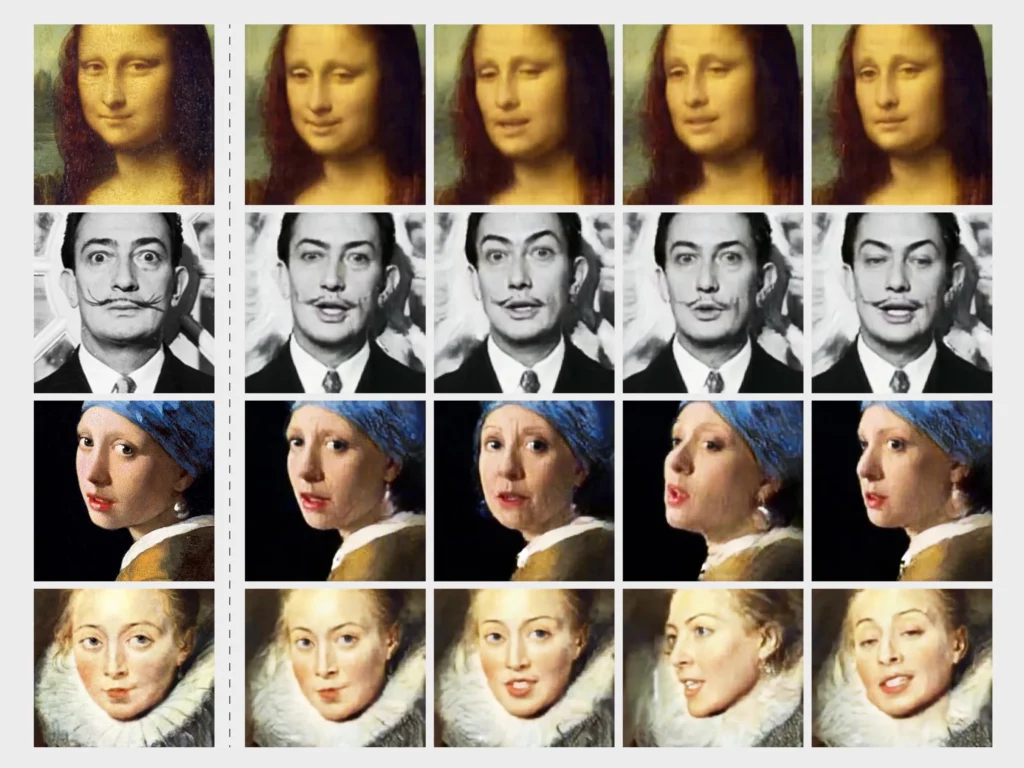

การสร้างวิดีโอปลอมที่เหมือนจริง ซึ่งมักเรียกกันว่า Deepfake ครั้งหนึ่งต้องใช้ซอฟต์แวร์ที่ซับซ้อนในการใส่ใบหน้าของบุคคลหนึ่งไปยังอีกบุคคลหนึ่ง แต่ตอนนี้ เครื่องมือจำนวนมากในการสร้างเครื่องมือเหล่านั้นมีให้สำหรับผู้บริโภคทั่วไป แม้กระทั่งในแอปบนสมาร์ทโฟน และมักจะใช้เงินเพียงเล็กน้อยหรือไม่มีเลย

วิดีโอที่ดัดแปลงใหม่ซึ่งส่วนใหญ่เป็นผลงานของผู้สร้างมีมและนักการตลาดได้แพร่ระบาดในเว็บไซต์โซเชียลมีเดียเช่น TikTok และ Twitter เนื้อหาที่พวกเขาผลิต ซึ่งบางครั้งเรียกว่าของปลอมราคาถูกโดยนักวิจัย ทำงานโดยการโคลนเสียงคนดัง ปรับเปลี่ยนการเคลื่อนไหวของปากให้ตรงกับเสียงทางเลือก และเขียนบทสนทนาที่โน้มน้าวใจ

วิดีโอและเทคโนโลยีที่สามารถเข้าถึงได้เบื้องหลังมี A.I. นักวิจัยกังวลเกี่ยวกับอันตรายของพวกเขา และได้แสดงความกังวลใหม่ว่าบริษัทสื่อสังคมออนไลน์เตรียมพร้อมรับมือกับการปลอมแปลงทางดิจิทัลที่กำลังเติบโตหรือไม่

หน่วยงานเฝ้าระวังข้อมูลบิดเบือนยังพยายามควบคุมคลื่นดิจิทัลปลอมที่อาจหลอกลวงผู้ชมหรือทำให้ยากต่อการรู้ว่าสิ่งใดจริงหรือเท็จทางออนไลน์

“สิ่งที่แตกต่างคือตอนนี้ทุกคนสามารถทำได้” Britt Paris ผู้ช่วยศาสตราจารย์ด้านบรรณารักษศาสตร์และสารสนเทศศาสตร์แห่งมหาวิทยาลัย Rutgers ผู้คิดค้นคำว่า “cheapfakes” กล่าว “ไม่ใช่แค่คนที่มีเทคโนโลยีการคำนวณที่ซับซ้อนและมีความรู้ในการคำนวณที่ค่อนข้างซับซ้อนเท่านั้น แต่เป็นแอปฟรี”

รีลของเนื้อหาที่ถูกดัดแปลงได้แพร่กระจายบน TikTok และที่อื่น ๆ เป็นเวลาหลายปี โดยทั่วไปแล้วจะใช้กลอุบายแบบสามัญประจำบ้านมากกว่า เช่น การตัดต่ออย่างระมัดระวังหรือการสลับคลิปเสียงหนึ่งไปยังอีกคลิปหนึ่ง ในวิดีโอหนึ่งบน TikTok รองประธานาธิบดีกมลา แฮร์ริสดูเหมือนจะกล่าวว่าทุกคนที่เข้ารับการรักษาในโรงพยาบาลเนื่องจากโควิด-19 ได้รับการฉีดวัคซีน ในความเป็นจริง เธอกล่าวว่าผู้ป่วยไม่ได้รับการฉีดวัคซีน

Graphika บริษัทวิจัยที่ศึกษาข้อมูลที่บิดเบือน ตรวจพบการปลอมแปลงของผู้ประกาศข่าวสมมติที่บัญชีบอทสนับสนุนจีนเผยแพร่เมื่อปลายปีที่แล้ว ในตัวอย่างแรกที่ทราบกันดีของเทคโนโลยีที่ใช้สำหรับแคมเปญที่มีอิทธิพลต่อรัฐ

แต่เครื่องมือใหม่ๆ หลายอย่างนำเสนอเทคโนโลยีที่คล้ายคลึงกันกับผู้ใช้อินเทอร์เน็ตทั่วไป เปิดโอกาสให้นักแสดงตลกและพรรคพวกสร้างการปลอมแปลงที่น่าเชื่อถือของตนเองได้

เมื่อเดือนที่แล้ว วิดีโอปลอมแพร่ภาพประธานาธิบดีไบเดนประกาศร่างกฎหมายระดับชาติสำหรับสงครามระหว่างรัสเซียและยูเครน วิดีโอนี้ผลิตโดยทีมงานที่อยู่เบื้องหลัง “Human Events Daily” ซึ่งเป็นพอดคาสต์และสตรีมสดที่ดำเนินการโดย Jack Posobiec ผู้มีอิทธิพลฝ่ายขวาซึ่งเป็นที่รู้จักจากการเผยแพร่ทฤษฎีสมคบคิด

ในส่วนที่อธิบายวิดีโอ นาย Posobiec กล่าวว่าทีมของเขาสร้างวิดีโอโดยใช้ A.I. เทคโนโลยี. ทวีตเกี่ยวกับวิดีโอจาก The Patriot Oasis ซึ่งเป็นบัญชีอนุรักษ์นิยม ใช้ป้ายกำกับข่าวด่วนโดยไม่ระบุว่าวิดีโอเป็นของปลอม ทวีตถูกดูมากกว่าแปดล้านครั้ง

คลิปวิดีโอหลายรายการที่มีเสียงสังเคราะห์ดูเหมือนจะใช้เทคโนโลยีจาก ElevenLabs บริษัทสตาร์ทอัพสัญชาติอเมริกันที่ร่วมก่อตั้งโดยอดีตวิศวกรของ Google ในเดือนพฤศจิกายน บริษัทได้เปิดตัวเครื่องมือการโคลนเสียงที่สามารถฝึกให้ทำซ้ำเสียงได้ภายในไม่กี่วินาที

ElevenLabs ดึงดูดความสนใจเมื่อเดือนที่แล้ว หลังจาก 4chan กระดานข้อความที่ขึ้นชื่อเรื่องเนื้อหาเหยียดผิวและสมรู้ร่วมคิด ใช้เครื่องมือนี้เพื่อแชร์ข้อความแสดงความเกลียดชัง ในตัวอย่างหนึ่ง ผู้ใช้ 4chan สร้างการบันทึกเสียงข้อความต่อต้านกลุ่มเซมิติกโดยใช้เสียงที่สร้างจากคอมพิวเตอร์โดยเลียนแบบนักแสดงเอ็มม่า วัตสัน มาเธอร์บอร์ดรายงานก่อนหน้านี้เกี่ยวกับการใช้เทคโนโลยีเสียงของ 4chan

ElevenLabs กล่าวบน Twitter ว่าจะแนะนำมาตรการป้องกันใหม่ เช่น การจำกัดการโคลนเสียงในบัญชีที่ชำระเงิน และจัดหา A.I. ใหม่ เครื่องมือตรวจจับ แต่ผู้ใช้ 4chan กล่าวว่าพวกเขาจะสร้างเทคโนโลยีการโคลนเสียงในเวอร์ชันของตนเองโดยใช้รหัสโอเพ่นซอร์ส โดยโพสต์การสาธิตที่ฟังดูคล้ายกับเสียงที่ผลิตโดย ElevenLabs

“เราต้องการมี AI ที่เรากำหนดเองพร้อมพลังในการสร้าง” ผู้ใช้ 4chan ที่ไม่ระบุชื่อเขียนในโพสต์เกี่ยวกับโครงการ

ในอีเมล โฆษกหญิงของ ElevenLabs กล่าวว่าบริษัทต้องการร่วมมือกับ A.I. นักพัฒนาเพื่อสร้างระบบตรวจจับสากลที่สามารถนำไปใช้ทั่วทั้งอุตสาหกรรม

วิดีโอที่ใช้เสียงเลียนแบบที่สร้างขึ้นด้วยเครื่องมือของ ElevenLabs หรือเทคโนโลยีที่คล้ายคลึงกัน ได้กลายเป็นไวรัลในช่วงไม่กี่สัปดาห์ที่ผ่านมา รายการหนึ่งโพสต์บน Twitter โดย Elon Musk เจ้าของเว็บไซต์ แสดงบทสนทนาปลอมๆ ที่ดูหยาบคายระหว่างคุณ Rogan, Mr. Musk และ Jordan Peterson นักเคลื่อนไหวเพื่อสิทธิของผู้ชายชาวแคนาดา ในอีกรายการหนึ่งที่โพสต์บน YouTube นายโรแกนดูเหมือนจะสัมภาษณ์นายกรัฐมนตรีจัสติน ทรูโดเวอร์ชั่นปลอมของแคนาดา เกี่ยวกับเรื่องอื้อฉาวทางการเมืองของเขา

“การผลิตของปลอมดังกล่าวควรเป็นอาชญากรรมที่มีโทษจำคุก 10 ปี” นายปีเตอร์สันกล่าวในทวีตเกี่ยวกับวิดีโอปลอมที่มีเสียงของเขา “เทคโนโลยีนี้อันตรายเกินจะเชื่อ”

ในแถลงการณ์ โฆษกหญิงของ YouTube กล่าวว่าวิดีโอของ Mr. Rogan และ Mr. Trudeau ไม่ได้ละเมิดนโยบายของแพลตฟอร์ม เนื่องจากวิดีโอดังกล่าว “ให้บริบทที่เพียงพอ” (ผู้สร้างได้อธิบายว่าเป็น “วิดีโอปลอม”) บริษัทกล่าวว่านโยบายการให้ข้อมูลที่ผิดได้ห้ามเนื้อหาที่ได้รับการดัดแปลงในลักษณะที่ทำให้เข้าใจผิด

ผู้เชี่ยวชาญที่ศึกษาเทคโนโลยี Deepfake แนะนำว่าโฆษณาปลอมที่มีคุณโรแกนและดร. ฮูเบอร์แมนน่าจะสร้างขึ้นด้วยโปรแกรมโคลนเสียง แม้ว่าเครื่องมือที่ใช้จะไม่ชัดเจนก็ตาม เสียงของ Mr. Rogan ถูกรวมเข้ากับการสัมภาษณ์จริงกับ Dr. Huberman ที่พูดถึงฮอร์โมนเทสโทสเตอโรน

ผลลัพธ์ไม่สมบูรณ์แบบ คลิปของ Mr. Rogan นำมาจากการสัมภาษณ์ที่ไม่เกี่ยวข้องซึ่งโพสต์เมื่อเดือนธันวาคมกับ Fedor Gorst ผู้เล่นพูลมืออาชีพ การเคลื่อนไหวของปากของ Mr. Rogan ไม่ตรงกับเสียง และเสียงของเขาก็ดูไม่เป็นธรรมชาติในบางครั้ง หากวิดีโอทำให้ผู้ใช้ TikTok เชื่อได้ ก็ยากที่จะบอกได้: วิดีโอดังกล่าวดึงดูดความสนใจได้มากขึ้นหลังจากถูกระบุว่าเป็นวิดีโอปลอมที่น่าประทับใจ

นโยบายของ TikTok ห้ามการปลอมแปลงดิจิทัล “ซึ่งทำให้ผู้ใช้เข้าใจผิดโดยการบิดเบือนความจริงของเหตุการณ์และก่อให้เกิดอันตรายอย่างมากต่อเนื้อหาของวิดีโอ บุคคลอื่นหรือสังคม” วิดีโอหลายรายการถูกลบออกหลังจากที่ The New York Times ตั้งค่าสถานะพวกเขาไปยังบริษัท Twitter ยังลบวิดีโอบางส่วน

โฆษกของ TikTok กล่าวว่า บริษัทใช้ “การผสมผสานระหว่างเทคโนโลยีและการกลั่นกรองโดยมนุษย์เพื่อตรวจจับและลบ” วิดีโอที่ดัดแปลง แต่ปฏิเสธที่จะให้รายละเอียดเกี่ยวกับวิธีการ

นายโรแกนและบริษัทที่แสดงในโฆษณาปลอมไม่ตอบสนองต่อคำร้องขอความคิดเห็น

บริษัทสื่อสังคมออนไลน์หลายแห่ง รวมถึง Meta และ Twitch ได้สั่งห้ามการทำ Deepfakes และดัดแปลงวิดีโอที่หลอกลวงผู้ใช้ Meta ซึ่งเป็นเจ้าของ Facebook และ Instagram จัดการแข่งขันในปี 2021 เพื่อพัฒนาโปรแกรมที่สามารถระบุ Deepfakes ได้ ส่งผลให้มีเครื่องมือหนึ่งที่สามารถตรวจจับพวกมันได้ 83 เปอร์เซ็นต์ของเวลาทั้งหมด

หน่วยงานกำกับดูแลของรัฐบาลกลางตอบสนองช้า กฎหมายของรัฐบาลกลางฉบับหนึ่งในปี 2019 ได้ร้องขอรายงานเกี่ยวกับการสร้างอาวุธของ Deepfake โดยชาวต่างชาติ หน่วยงานรัฐบาลต้องแจ้งให้รัฐสภาทราบหาก Deepfakes กำหนดเป้าหมายไปที่การเลือกตั้งในสหรัฐอเมริกา และสร้างรางวัลเพื่อสนับสนุนการวิจัยเกี่ยวกับเครื่องมือที่สามารถตรวจจับ Deepfake

“เราไม่สามารถรอถึงสองปีจนกว่ากฎหมายจะผ่าน” Ravit Dotan นักวิจัยหลังปริญญาเอกที่ดูแล Collaborative A.I. กล่าว ห้องปฏิบัติการความรับผิดชอบที่มหาวิทยาลัยพิตต์สเบิร์ก “ถึงตอนนั้น ความเสียหายอาจมากเกินไป เรามีการเลือกตั้งที่จะมาถึงที่นี่ในสหรัฐฯ มันจะเป็นประเด็น”