ไมโครซอฟท์ นำเสนอ KOSMOS-1 ซึ่งสร้างจากเครื่องมือ MLLM ที่ช่วยพัฒนา AI ให้ใกล้เคียงมนุษย์มากยิ่งขึ้น ตอบสนองได้ใกล้เคียงมนุษย์ สามารถรับรู้ในรูปแบบทั่วไป สามารถทำตามคำแนะนำ และสามารถเรียนรู้ความหมายแฝงในบริบทได้

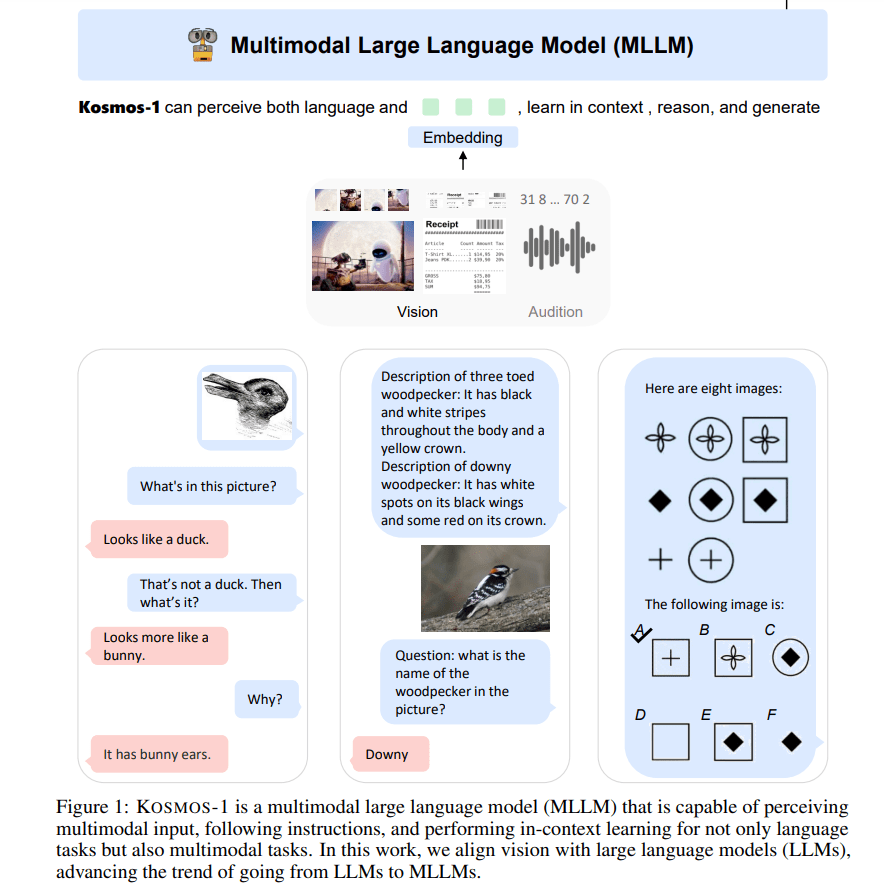

Toward AGI: Microsoft’s KOSMOS-1 MLLM Can Perceive General Modalities, Follow Instructions, and Perform In-Context Learning Large language models (LLMs) have emerged as powerful tools for a wide range of natural language processing (NLP) tasks. The push toward humanlike artificial general intelligence (AGI) however will require equipping such models with additional capabilities — and multimodal perception is an essential next step.

KOSMOS-1 MLLM ของ Microsoft ก้าวต่อไปสู่ AI ที่ใกล้เคียงมนุษย์มากยิ่งขึ้น

ปัญญาประดิษฐ์ที่ใกล้เคียงมนุษย์ สามารถรับรู้รูปแบบทั่วไป ทำตามคำแนะนำ และสามารถเรียนรู้ความหมายแฝงในบริบทได้

โมเดลภาษาขนาดใหญ่ Large language models (LLM) กลายเป็นเครื่องมือที่มีประสิทธิภาพสำหรับงานประมวลผลภาษาธรรมชาติ (NLP) ที่หลากหลาย อย่างไรก็ตาม การผลักดันไปสู่ปัญญาประดิษฐ์ที่ใกล้เคียงมนุษย์ (Artificial general intelligence – AGI) จะต้องเตรียมโมเดลดังกล่าวให้มีความสามารถเพิ่มเติม — และการรับรู้หลายรูปแบบเป็นขั้นตอนต่อไปที่สำคัญ

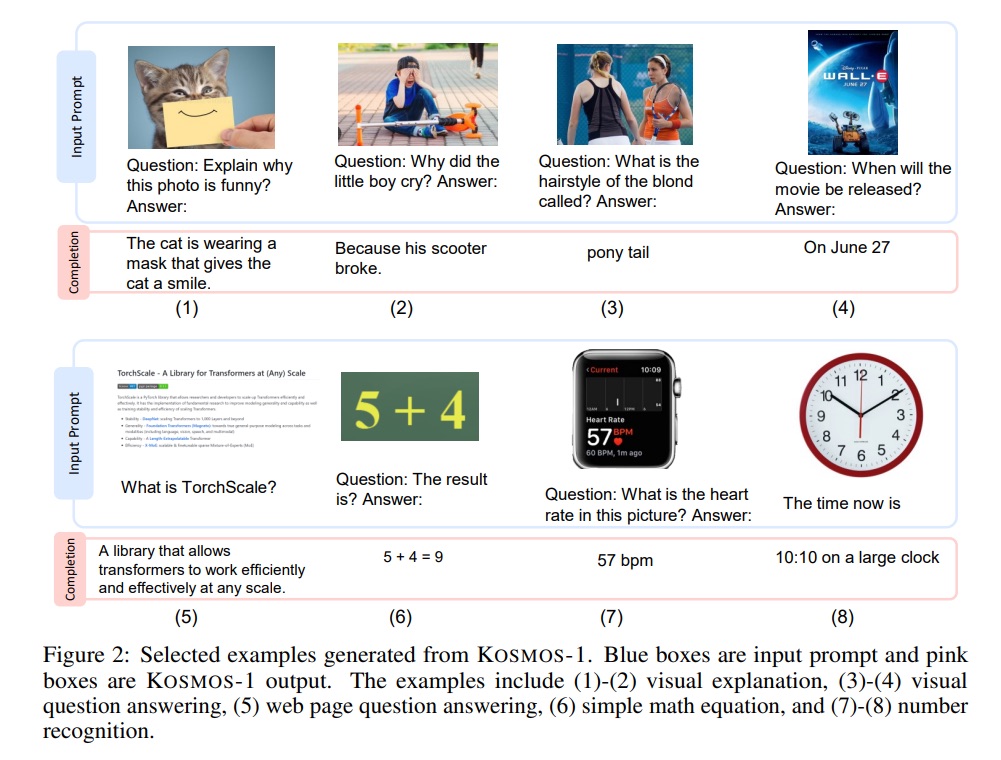

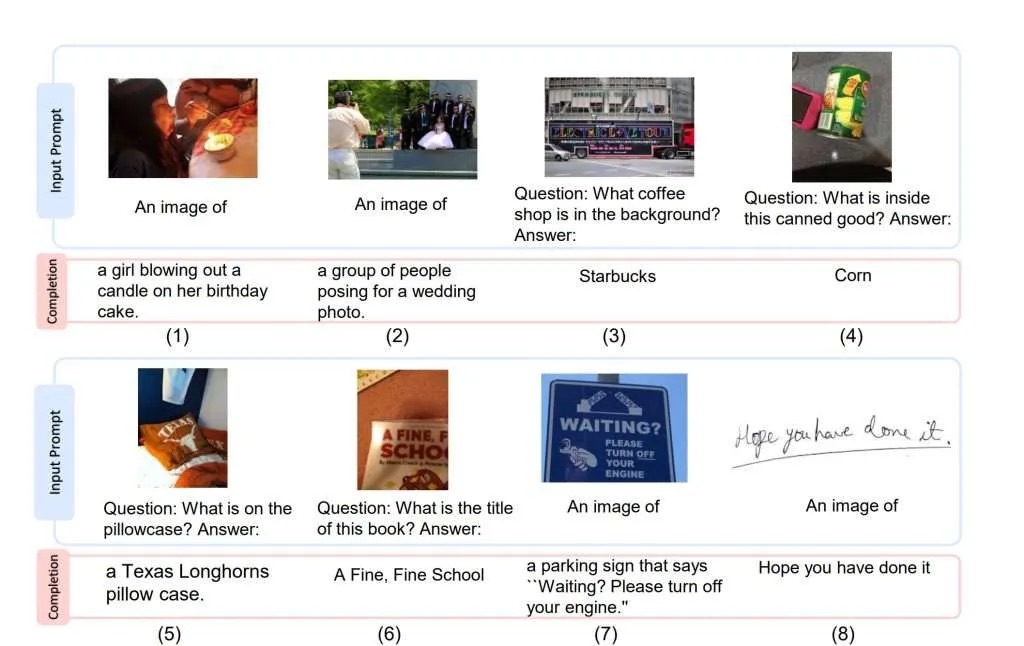

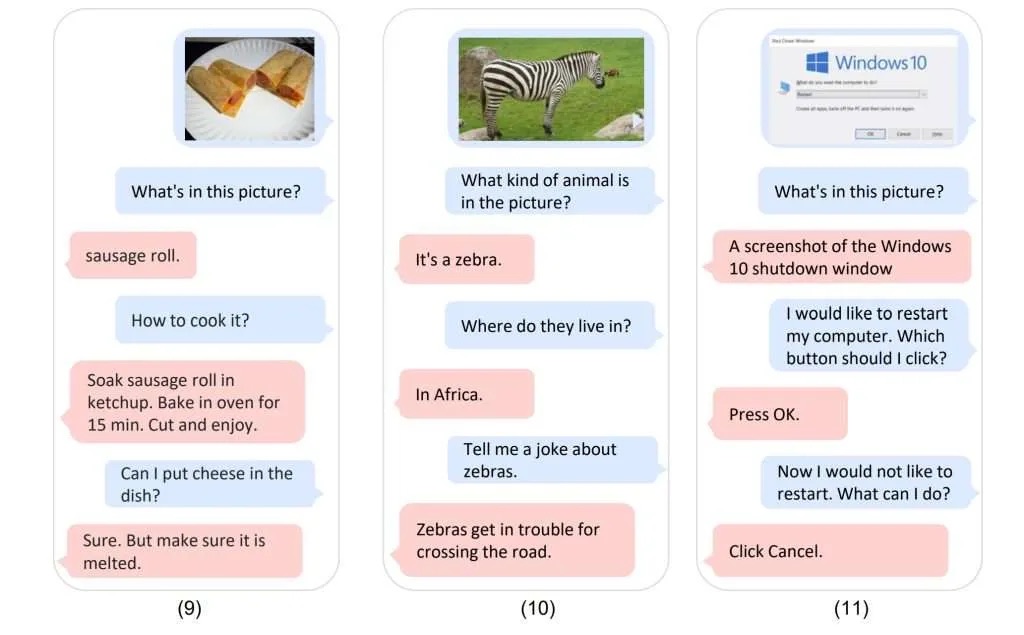

ในผลงานวิจัยของทีมงาน Microsoft ที่เพิ่งเผยแพร่ Language Is Not All You Need: Aligning Perception with Language Models ทีมวิจัยได้นำเสนอ KOSMOS-1 ซึ่งเป็นรูปแบบภาษาขนาดใหญ่หลายรูปแบบ multimodal large language model (MLLM) ที่สามารถรับรู้รูปแบบทั่วไป เรียนรู้ความหมายในบริบท และปฏิบัติตามคำแนะนำ KOSMOS-1 บรรลุประสิทธิภาพที่น่าประทับใจในด้านภาษา ภาษาการรับรู้ และการมองเห็น

นักวิจัยเสนอว่า LLMs ที่มีการรับรู้หลายรูปแบบจะมีความพร้อมที่ดีกว่าในการได้รับความรู้ทั่วไปนอกเหนือจากข้อมูลที่พวกเขารวบรวมจากข้อความเพียงอย่างเดียว และการเพิ่มคุณค่าการรับรู้นี้จะอำนวยความสะดวกในการใช้งาน LLM ในโดเมนใหม่ เช่น วิทยาการหุ่นยนต์ และระบบอัจฉริยะด้านเอกสาร การรับรู้หลายรูปแบบยังมีประโยชน์ในการรวม API หลายตัวเข้าด้วยกันเพื่อสร้างส่วนต่อประสานกราฟิกกับผู้ใช้ทั่วไปเพียงส่วนเดียว

KOSMOS-1 เป็นไปตามกระบวนการฝึกอบรม MetaLM โดยที่ LLM ที่ใช้ transformer ทำหน้าที่เป็นอินเทอร์เฟซอเนกประสงค์ และเสริมด้วยโมดูลการรับรู้ต่างๆ สอดคล้องกับปรัชญาของ MetaLM ทีมงานถือว่าโมเดลภาษาเป็นชั้นงานสากล ทำให้ KOSMOS-1 สามารถรวมการคาดคะเนงานต่างๆ เป็นข้อความ และสามารถจัดการกับคำสั่งภาษาธรรมชาติและลำดับการกระทำได้

จากบริบทก่อนหน้านี้ KOSMOS-1 เรียนรู้ที่จะสร้างข้อความในลักษณะการย้อนกลับอัตโนมัติ โมดัลลิตีอินพุตที่ไม่ใช่ข้อความทั้งหมดจะถูกฝังและป้อนเข้าสู่โมเดลภาษาเชิงสาเหตุ ที่ใช้ทรานส์ฟอร์เมอร์เป็นแบ็คโบน โดยมี decoder ของทรานส์ฟอร์มทำหน้าที่เป็นอินเตอร์เฟส general-purpose interface สำหรับโมดัลลิตี้ทั้งหมด โดยการโต้ตอบกับภาษาธรรมชาติและรูปแบบอื่น ๆ KOSMOS-1 จะสืบทอดความสามารถของการเรียนรู้ในบริบทและคำสั่งต่อไปนี้โดยธรรมชาติ และสามารถจัดการกับงานทั้งด้านภาษาและการรับรู้ได้

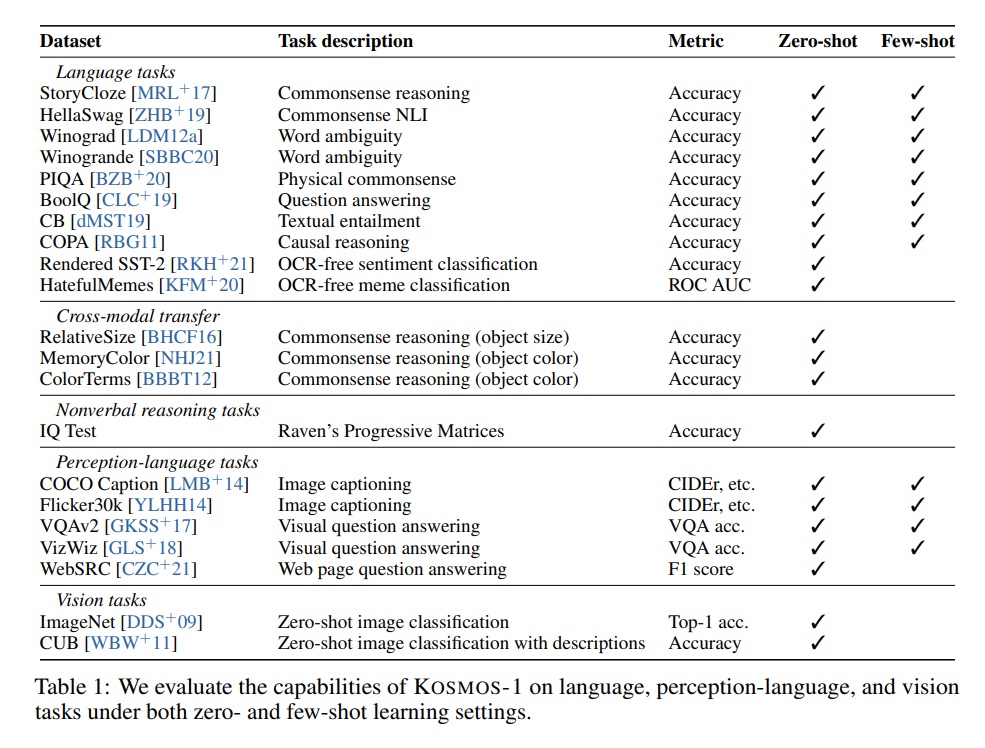

ในการศึกษาเชิงประจักษ์ ทีมเทรนนิ่ง KOSMOS-1 บน web-scale multimodal corpora และทำการทดลองเกี่ยวกับภาษาและงานต่อเนื่องหลายรูปแบบ และการทดสอบ Raven IQ KOSMOS-1 บรรลุผลการปฏิบัติงานที่น่าประทับใจในทุกงาน โดยแสดงให้เห็นถึงการรับรู้หลายรูปแบบที่แข็งแกร่งและความสามารถในการให้เหตุผลแบบอวัจนภาษา (Nonverbal communication) การสื่อสารโดยไม่ใช้ การพูด การอ่านตามตัวหนังสือ และการเขียนเป็นตัวหนังสือ

ใน KOSMOS-1 นักวิจัยได้แนะนำ MLLM ที่มีความสามารถ และโอกาสใหม่ๆ ในอนาคตพวกเขาวางแผนที่จะติดตั้ง KOSMOS-1 พร้อมเสียงพูด และเพิ่มขนาดของโมเดล

คุณสามารถศึกษารายละเอียดเพิ่มเติมจากงานวิจัย Language Is Not All You Need: Aligning Perception with Language Models ที่ได้เผยแพร่อยู่บน arXiv