Dolly 2.0 โมเดล Large Language Model แบบเปิดตัวแรก ที่เปิดให้นำไปใช้เพื่อประโยชน์ทางการค้าได้ ในขณะที่ โมเดล LLMs ต่างๆ เช่น LLaMA, Alpaca และ Vicuña ไม่อนุญาตให้นำไปใช้เพื่อประโยชน์ทางการค้า (Non-Commercial license) ล่าสุด Databricks เปิดตัว Dolly 2.0 ซึ่งเป็นเวอร์ชันถัดไปของโมเดลภาษาขนาดใหญ่ (LLM) พร้อมการโต้ตอบของมนุษย์ที่คล้ายกับ ChatGPT (หรือที่เรียกว่าการทำตามคำสั่ง prompt)

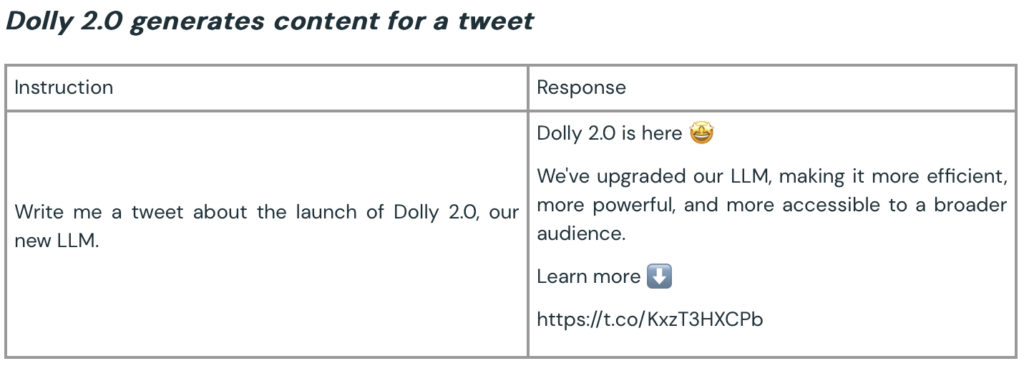

Today Databricks released Dolly 2.0, the next version of the large language model (LLM) with ChatGPT-like human interactivity (aka instruction-following) that the company released just two weeks ago.

Databricks เปิดตัว Dolly 2.0 ซึ่งเป็น LLM แบบเปิดตัวแรกที่เปิดให้ใช้งานเชิงพาณิชย์

บริษัทกล่าวว่า Dolly 2.0 เป็น LLM แบบโอเพ่นซอร์สตัวแรกที่ปรับแต่งตามคำแนะนำบนชุดข้อมูลที่โปร่งใสและใช้งานได้ฟรีซึ่งเป็นแบบโอเพ่นซอร์สเพื่อใช้ในเชิงพาณิชย์ นั่นหมายความว่า Dolly 2.0 พร้อมใช้งานสำหรับแอปพลิเคชันเชิงพาณิชย์โดยไม่จำเป็นต้องจ่ายค่าเข้าถึง API หรือแชร์ข้อมูลกับบุคคลที่สาม

ตามที่ Ali Ghodsi CEO ของ Databricks กล่าวว่าในขณะที่มี LLM อื่น ๆ ที่สามารถใช้เพื่อวัตถุประสงค์ทางการค้าได้ “พวกเขาจะไม่คุยกับคุณเหมือน Dolly 2.0” และเขาอธิบายว่าผู้ใช้สามารถแก้ไขและปรับปรุงข้อมูลการฝึกอบรมได้เนื่องจากข้อมูลนี้เปิดให้ใช้งานฟรีภายใต้ใบอนุญาตแบบโอเพ่นซอร์ส “ดังนั้นคุณสามารถสร้าง Dolly ในเวอร์ชันของคุณเองได้” เขากล่าว

Databricks เปิดตัวชุดข้อมูล Dolly 2.0

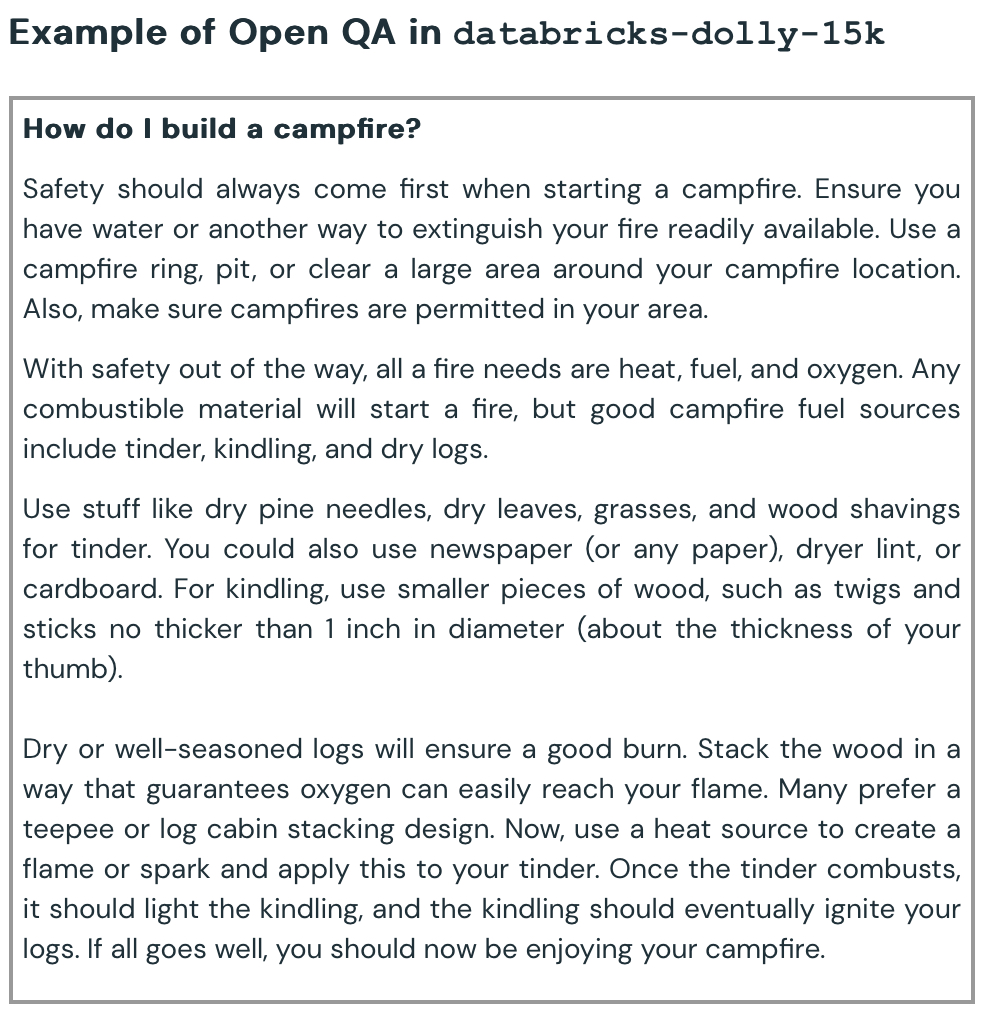

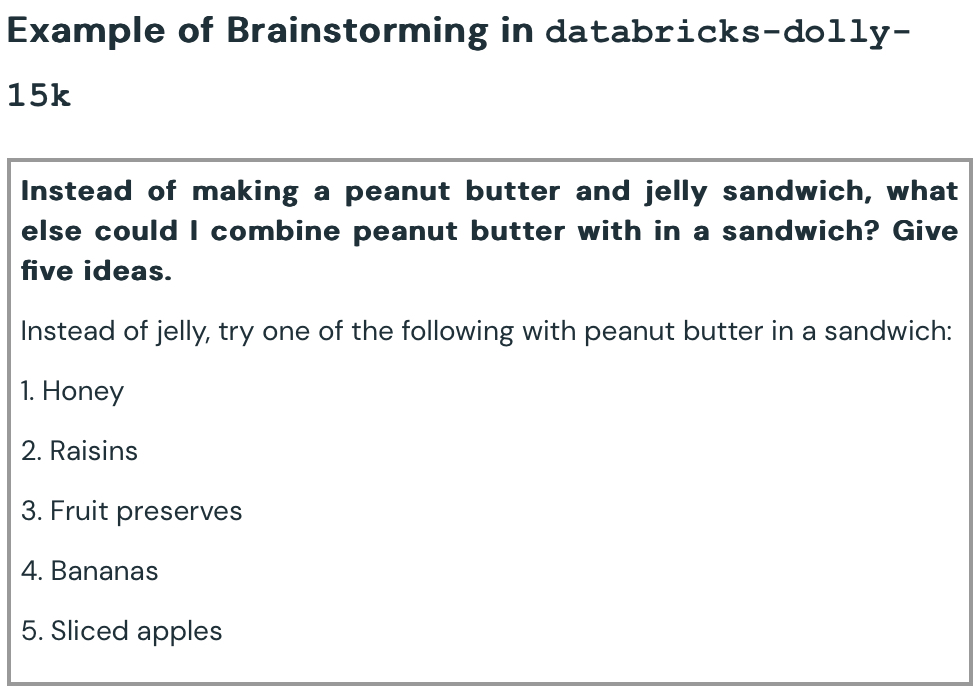

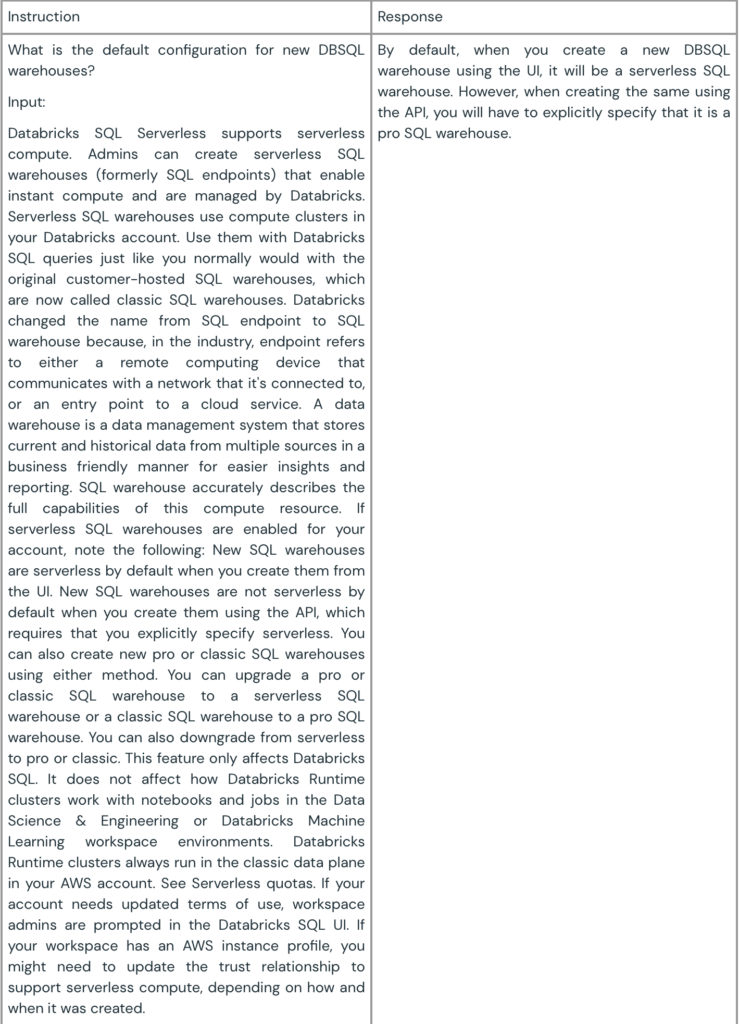

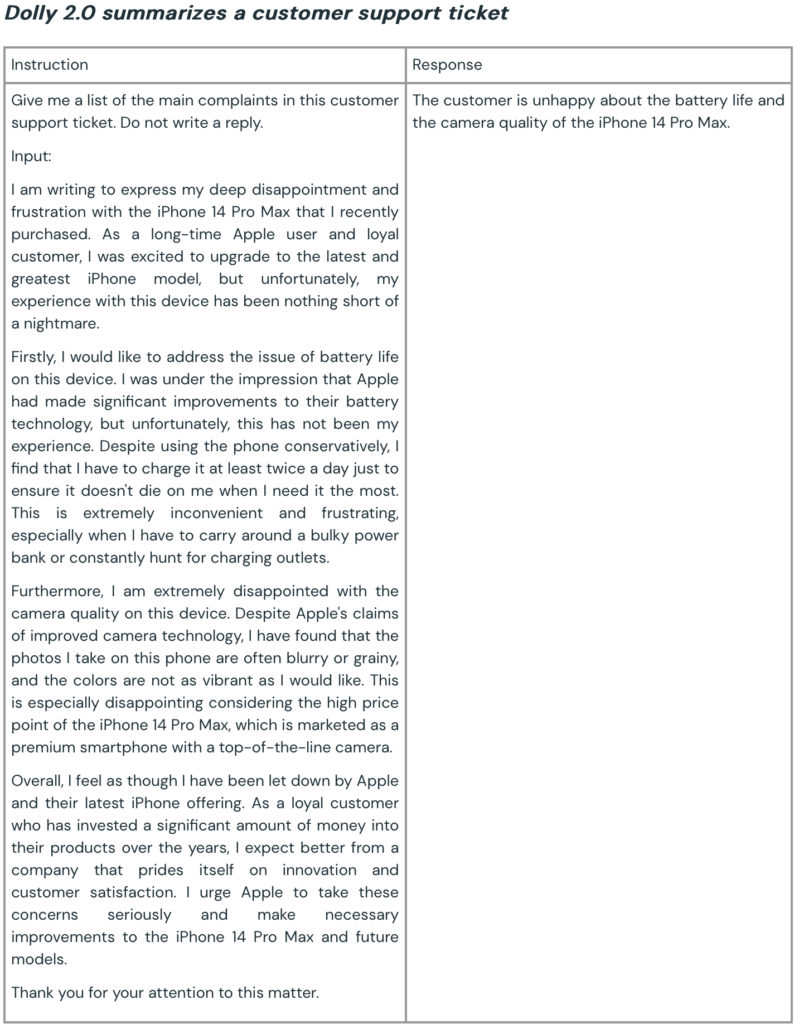

Databricks กล่าวว่า ในฐานะที่เป็นส่วนหนึ่งของความมุ่งมั่นอย่างต่อเนื่องที่มีต่อโอเพ่นซอร์ส ทางบริษัทยังเปิดตัวชุดข้อมูลที่ Dolly 2.0 ได้รับการปรับแต่งอย่างละเอียด เรียกว่า databricks-dolly-15k นี่คือคลังข้อมูลมากกว่า 15,000 ระเบียนที่สร้างขึ้นโดยพนักงานของ Databricks หลายพันคน และ Databricks กล่าวว่าเป็น “โอเพ่นซอร์สแห่งแรก คลังคำสั่งที่มนุษย์สร้างขึ้นซึ่งออกแบบมาโดยเฉพาะเพื่อให้ภาษาขนาดใหญ่สามารถแสดงการโต้ตอบที่น่าอัศจรรย์ของ ChatGPT”

ในช่วงเดือนที่ผ่านมา มีการเปิดตัว LLM ที่มีลักษณะคล้าย ChatGPT ซึ่งเป็นโอเพ่นซอร์ส คือ LLaMA ของ Meta ซึ่งเป็นแรงบันดาลใจให้กับผู้อื่นเช่น Alpaca, Koala, Vicuna และ Dolly 1.0 ของ Databricks

อย่างไรก็ตาม โมเดล “เปิด” เหล่านี้ จำนวนมากอยู่ภายใต้ “industrial capture” Ghodsi กล่าว เนื่องจากพวกเขาได้รับการฝึกฝนเกี่ยวกับชุดข้อมูลที่มีข้อกำหนดจำกัดการใช้งานเชิงพาณิชย์ เช่น ชุดข้อมูลคำถามและคำตอบ 52,000 รายการจากโครงการ Alpaca ของมหาวิทยาลัยสแตนฟอร์ด ที่ได้รับการฝึกอบรมเกี่ยวกับเอาต์พุตจาก ChatGPT ของ OpenAI แต่เขาอธิบายเงื่อนไขการใช้งานของ OpenAI รวมถึงกฎที่คุณไม่สามารถใช้ผลลัพธ์จากบริการที่แข่งขันกับ OpenAI

อย่างไรก็ตาม Databricks ค้นพบวิธีแก้ไขปัญหานี้: Dolly 2.0 เป็นโมเดลภาษา 12 พันล้านพารามิเตอร์ ที่อ้างอิงจากตระกูลโมเดล Eleuther AI pythia แบบโอเพ่นซอร์ส และปรับแต่งเฉพาะในคลังข้อมูลคำสั่งขนาดเล็กแบบโอเพ่นซอร์ส (databricks-dolly-15k) ที่สร้างโดยพนักงานของ Databricks เงื่อนไขการอนุญาตให้ใช้สิทธิ์ของชุดข้อมูลนี้อนุญาตให้ใช้ แก้ไข และขยายเพื่อวัตถุประสงค์ใดๆ รวมถึงการใช้งานทางวิชาการหรือเชิงพาณิชย์

โมเดลที่ผ่านการฝึกอบรมเกี่ยวกับเอาต์พุต ChatGPT จนถึงขณะนี้ อยู่ในพื้นที่สีเทาทางกฎหมาย “ทั้งชุมชนต่างก็มองข้ามสิ่งนี้ และทุกคนก็ปล่อยโมเดลเหล่านี้ออกมา แต่ไม่มีใครสามารถนำไปใช้ในเชิงพาณิชย์ได้” Ghodsi กล่าว “นั่นเป็นเหตุผลว่าทำไมเราถึงตื่นเต้นมาก”

Dolly 2.0 มีขนาดเล็กแต่ทรงพลัง

บล็อกโพสต์ของ Databricks ย้ำว่าเช่นเดียวกับ Dolly ดั้งเดิม เวอร์ชัน 2.0 นั้นไม่ล้ำสมัย แต่ “แสดงพฤติกรรมการทำตามคำสั่งในระดับที่มีความสามารถอย่างน่าประหลาดใจเมื่อพิจารณาจากขนาดของคลังข้อมูลการฝึกอบรม” โพสต์เสริมว่าระดับของความพยายามและค่าใช้จ่ายที่จำเป็นในการสร้างเทคโนโลยี AI ที่ทรงพลังคือ “ลำดับความสำคัญน้อยกว่าที่เคยจินตนาการไว้”

“ใครๆ ก็อยากไปให้ใหญ่ขึ้น แต่จริงๆ แล้วเราสนใจที่เล็กกว่านี้” Ghodsi กล่าวถึงขนาดที่เล็กลงของ Dolly “อย่างที่สอง มันมีคุณภาพสูง เราดูคำตอบทั้งหมดแล้ว”

Ghodi เสริมว่าเขาเชื่อว่า Dolly 2.0 จะเริ่มเอฟเฟกต์ “snow ball” ซึ่งคนอื่นๆ ในชุมชน AI สามารถเข้าร่วมและคิดทางเลือกอื่นๆ ได้ เขาอธิบายว่าข้อจำกัดในการใช้งานเชิงพาณิชย์เป็นอุปสรรคใหญ่ที่ต้องเอาชนะ: “ตอนนี้เรารู้สึกตื่นเต้นที่ในที่สุดเราก็พบวิธีแก้ไข ฉันสัญญาว่าคุณจะเห็นผู้คนใช้คำถาม 15,000 ข้อ กับโมเดลทุกแบบที่มีอยู่ และพวกเขาจะได้เห็นว่าจู่ๆ โมเดลเหล่านี้กี่แบบกลายเป็นสิ่งมหัศจรรย์ ซึ่งคุณสามารถโต้ตอบกับพวกมันได้”