GPT-4 เป็น Large Language Model ล่าสุดที่ OpenAI ได้เปิดตัว โดย multimodal nature sets ทำให้แตกต่างจาก LLM ที่มีก่อนหน้านี้ทั้งหมด สถาปัตยกรรมทรานส์ฟอร์เมอร์ของ GPT เป็นเทคโนโลยีที่อยู่เบื้องหลัง ChatGPT ที่รู้จักกันดี ซึ่งทำให้สามารถเลียนแบบมนุษย์ได้ด้วยความเข้าใจภาษาธรรมชาติที่ดีมาก

GPT-4 is the latest Large Language Model that OpenAI has released. Its multimodal nature sets it apart from all the previously introduced LLMs. GPT’s transformer architecture is the technology behind the well-known ChatGPT that makes it capable of imitating humans by super good Natural Language Understanding.

Source: https://github.com/Vision-CAIR/MiniGPT-4

พบกับ MiniGPT-4: โมเดล AI แบบโอเพ่นซอร์สที่ทำงาน Vision-Language Tasks ที่ซับซ้อนได้เช่นเดียวกับ GPT-4

GPT-4 เป็น Large Language Model ล่าสุดที่ OpenAI ได้เปิดตัว โดย multimodal nature sets ทำให้แตกต่างจาก LLM ที่มีก่อนหน้านี้ทั้งหมด สถาปัตยกรรมทรานส์ฟอร์เมอร์ของ GPT เป็นเทคโนโลยีที่อยู่เบื้องหลัง ChatGPT ที่รู้จักกันดี ซึ่งทำให้สามารถเลียนแบบมนุษย์ได้ด้วยความเข้าใจภาษาธรรมชาติที่ดีมาก GPT-4 ได้แสดงให้เห็นถึงประสิทธิภาพที่ยอดเยี่ยมในการแก้ปัญหาต่างๆ เช่น การสร้างคำอธิบายภาพที่ละเอียดและแม่นยำ การอธิบายปรากฏการณ์ทางภาพที่ผิดปกติ การพัฒนาเว็บไซต์โดยใช้คำสั่งข้อความที่เขียนด้วยลายมือ และอื่นๆ ผู้ใช้บางคนใช้มันเพื่อสร้างวิดีโอเกมและส่วนขยายของ Chrome และเพื่ออธิบายคำถามเหตุผลที่ซับซ้อน

เหตุผลที่อยู่เบื้องหลังประสิทธิภาพที่ยอดเยี่ยมของ GPT-4 ยังไม่เป็นที่เข้าใจอย่างสมบูรณ์ ผู้เขียนรายงานการวิจัยที่เพิ่งเปิดตัวเชื่อว่าความสามารถขั้นสูงของ GPT-4 อาจเกิดจากการใช้ Large Language Model ขั้นสูง การวิจัยก่อนหน้านี้แสดงให้เห็นว่า LLMs มีศักยภาพที่ดีเพียงใด ซึ่งส่วนใหญ่ไม่มีอยู่ในโมเดลขนาดเล็ก ผู้เขียนจึงได้เสนอโมเดลใหม่ที่เรียกว่า MiniGPT-4 เพื่อสำรวจสมมติฐานโดยละเอียด MiniGPT-4 เป็นโมเดลโอเพ่นซอร์สที่สามารถทำงานด้านภาษาการมองเห็นที่ซับซ้อน (complex vision-language tasks) ได้เช่นเดียวกับ GPT-4

พัฒนาโดยทีมงานของ Ph.D. นักศึกษาจาก King Abdullah University of Science and Technology ประเทศซาอุดีอาระเบีย MiniGPT-4 มีความสามารถที่คล้ายคลึงกันกับที่แสดงโดย GPT-4 เช่น การสร้างคำอธิบายรูปภาพโดยละเอียดและการสร้างเว็บไซต์จากแบบร่างที่เขียนด้วยมือ MiniGPT-4 ใช้ LLM ขั้นสูงที่เรียกว่า Vicuna เป็นตัวถอดรหัสภาษา ซึ่งสร้างขึ้นจาก LLaMA และมีรายงานว่าบรรลุถึง 90% ของคุณภาพของ ChatGPT ตามที่ประเมินโดย GPT-4 MiniGPT-4 ได้ใช้องค์ประกอบการมองเห็นที่ฝึกไว้ล่วงหน้าของ BLIP-2 (การฝึกอบรมล่วงหน้าภาษา Bootstrapping-Image) และได้เพิ่มเลเยอร์การฉายภาพเดียวเพื่อจัดแนวคุณลักษณะภาพที่เข้ารหัสด้วยโมเดลภาษา Vicuna โดยการแช่แข็งส่วนประกอบการมองเห็นและภาษาอื่นๆ ทั้งหมด

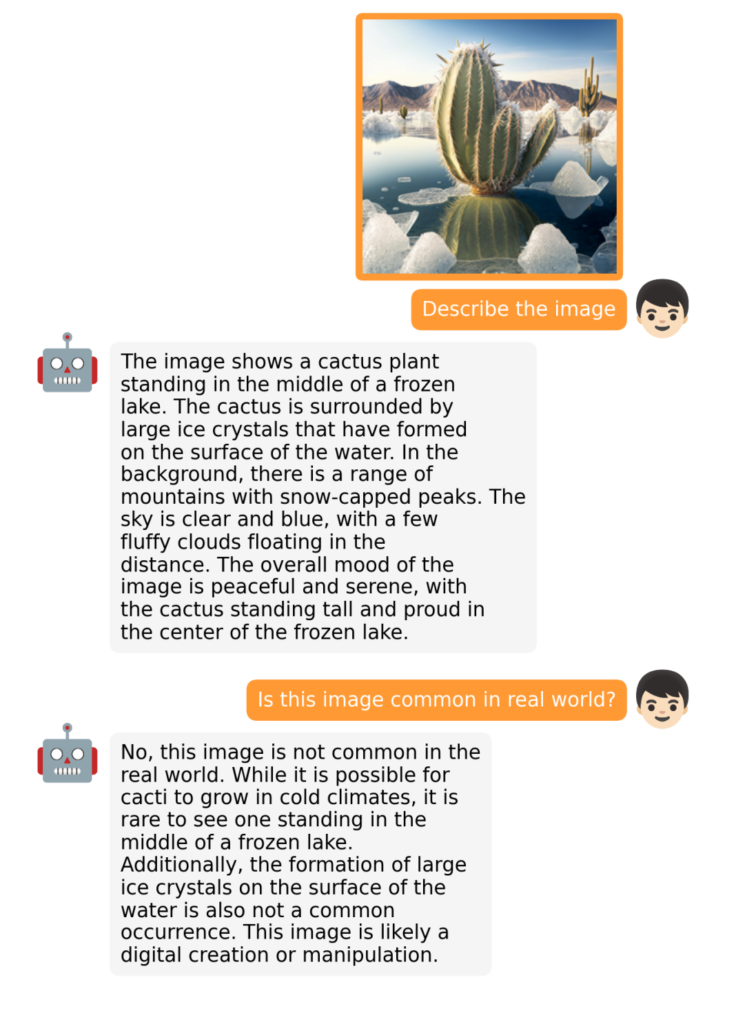

MiniGPT-4 แสดงผลลัพธ์ที่ยอดเยี่ยมเมื่อถูกขอให้ระบุปัญหาจากการป้อนรูปภาพ มันให้วิธีแก้ปัญหาตามการป้อนข้อมูลรูปภาพของพืชที่เป็นโรคโดยผู้ใช้พร้อมการถามทันทีว่ามีอะไรผิดปกติกับพืช มันค้นพบเนื้อหาที่ผิดปกติในรูปภาพ, เขียนโฆษณาผลิตภัณฑ์, สร้างสูตรอาหารอย่างละเอียดโดยสังเกตภาพถ่ายอาหารอร่อย, สร้างเพลงแร็พที่ได้รับแรงบันดาลใจจากรูปภาพ, และดึงข้อมูลข้อเท็จจริงเกี่ยวกับผู้คน, ภาพยนตร์หรือศิลปะจากรูปภาพโดยตรง

จากการศึกษาของพวกเขา ทีมงานกล่าวว่าการฝึกเลเยอร์การฉายภาพหนึ่งเลเยอร์สามารถจัดแนวคุณลักษณะด้านภาพกับ LLM ได้อย่างมีประสิทธิภาพ MiniGPT-4 ต้องการการฝึกอบรมเพียง 10 ชั่วโมงโดยประมาณบน GPU A100 4 ตัว นอกจากนี้ ทีมงานยังได้แบ่งปันว่าการพัฒนาโมเดล MiniGPT-4 ที่มีประสิทธิภาพสูงนั้นยากเพียงใดโดยเพียงแค่จัดองค์ประกอบภาพให้สอดคล้องกับ LLM โดยใช้คู่รูปภาพและข้อความดิบจากชุดข้อมูลสาธารณะ เนื่องจากอาจส่งผลให้เกิดวลีซ้ำหรือประโยคที่แยกส่วน เพื่อเอาชนะข้อจำกัดนี้ MiniGPT-4 จำเป็นต้องได้รับการฝึกฝนโดยใช้ชุดข้อมูลคุณภาพสูงและสอดคล้องกัน ดังนั้น จึงช่วยเพิ่มความสามารถในการใช้งานของโมเดลโดยสร้างเอาต์พุตภาษาที่เป็นธรรมชาติและเชื่อมโยงกันมากขึ้น

MiniGPT-4 ดูเหมือนจะเป็นการพัฒนาที่มีแนวโน้มเนื่องจาก multimodal generation capabilities ที่น่าทึ่ง คุณสมบัติที่สำคัญที่สุดประการหนึ่งคือประสิทธิภาพการคำนวณที่สูง และต้องการดาต้าเซ็ต แค่ประมาณ 5 million aligned image-text pairs ใช้เทรนนิ่ง projection layer โดยเป็นโอเพ่นซอร์ส มีโค้ดโปรแกรม pre-trained model และชุดดาต้าเซ็ต ให้ เพื่อนำไปใช้ต่อยอดได้เลย

Tanya Malhotra is a final year undergrad from the University of Petroleum & Energy Studies.