OpenAI เสนอรางวัลเงินสดสูงถึง 20,000 ดอลลาร์ แก่ผู้เปิดเผยช่องโหว่ด้านความปลอดภัยใน API รวมถึง ChatGPT

OpenAI is offering cash rewards of up to $20,000 for disclosing security vulnerabilities in its APIs, including ChatGPT.

OpenAI ตั้งรางวัลสำหรับผู้ค้นพบบั๊ก ChatGPT — แต่ไม่มีรางวัลให้ Jailbreaking

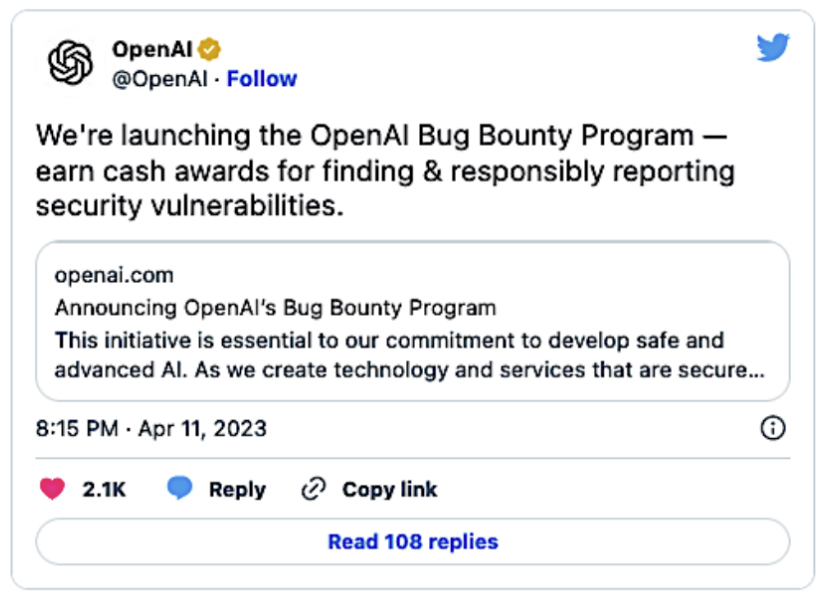

OpenAI ได้เปิดตัว Bug Bounty กระตุ้นให้สมาชิกทั่วไปค้นหาและเปิดเผยช่องโหว่ในบริการ AI รวมถึง ChatGPT รางวัลมีตั้งแต่ $200 สำหรับ “การค้นพบที่มีความรุนแรงต่ำ” ไปจนถึง $20,000 สำหรับ “การค้นพบที่พิเศษ” และสามารถส่งรายงานผ่าน Bugcrowd ซึ่งเป็นแพลตฟอร์มความปลอดภัยทางไซเบอร์แบบ crowdsourcing

โดยเฉพาะอย่างยิ่ง รางวัลดังกล่าวไม่รวมรางวัลสำหรับ Jailbreaking ChatGPT หรือทำให้มันสร้างข้อความ หรือโค้ดที่เป็นอันตราย (generate malicious code) “การโจมตีทุกรูปแบบที่สร้างปัญหากับโมเดล การให้คำตอบ หรือ prompt จะไม่ได้รับรางวัล” เงื่อนไขระบุไว้ชัดเจนในหน้า Bugcrowd ของ OpenAI

การ Jailbreaking ChatGPT มักจะเกี่ยวข้องกับการป้อนสถานการณ์ที่ซับซ้อนในระบบที่อนุญาตให้ข้ามตัวกรองความปลอดภัยของตัวเอง สิ่งเหล่านี้อาจรวมถึงการสนับสนุนให้แชทบอทสวมบทบาทเป็น “evil twin” ผู้ใช้จึงสามารถสั่งงานที่ถูกแบน เช่น คำพูดแสดงความเกลียดชัง หรือขอคำแนะนำในการสร้างอาวุธ

OpenAI กล่าวว่า “ปัญหาด้านความปลอดภัยของโมเดลไม่เหมาะกับโปรแกรมรางวัลบั๊ก เนื่องจากไม่ใช่บั๊กเฉพาะบุคคล ที่สามารถแก้ไขได้โดยตรง” บริษัทตั้งข้อสังเกตว่า “การแก้ไขปัญหาเหล่านี้มักเกี่ยวข้องกับการวิจัยจำนวนมากและแนวทางที่กว้างขึ้น” และควรส่งรายงานสำหรับปัญหาดังกล่าวผ่านหน้าข้อเสนอแนะแบบจำลองของบริษัท

แม้ว่า Jailbreaking ดังกล่าวจะแสดงให้เห็นถึงช่องโหว่ที่กว้างขึ้นของระบบ AI แต่ปัญหาเหล่านี้น่าจะไม่ใช่ปัญหาโดยตรงสำหรับ OpenAI เมื่อเทียบกับความล้มเหลวด้านความปลอดภัยแบบดั้งเดิม ตัวอย่างเช่น เมื่อเดือนที่แล้ว แฮ็กเกอร์ที่รู้จักกันในชื่อ rez0 สามารถเปิดเผย “secret plugins” 80 รายการสำหรับ ChatGPT API — ที่ยังไม่ได้เผยแพร่หรือส่วนเสริมทดลองสำหรับแชทบอทของบริษัท (Rez0 สังเกตว่าช่องโหว่ได้รับการแก้ไขภายในหนึ่งวันหลังจากที่พวกเขาเปิดเผยบน Twitter)

ดังที่ผู้ใช้คนหนึ่งตอบกลับทวีต: “หากพวกเขามีโปรแกรม #BugBounty ให้รางวัลแก่ผู้ช่วยค้นหาบั๊ก ฉันแน่ใจว่าผู้ใช้จำนวนมากสามารถช่วยพวกเขาค้นหาบั๊กต่างๆ ได้มากมาย ในอนาคต