วิธีการใหม่ทำให้เครื่องมือ เช่น Stable Diffusion และ DALL-E-3 เร็วขึ้นโดยทำให้กระบวนการสร้างภาพง่ายขึ้นในขั้นตอนเดียว ในขณะเดียวกันก็รักษาหรือปรับปรุงคุณภาพของภาพไปด้วย

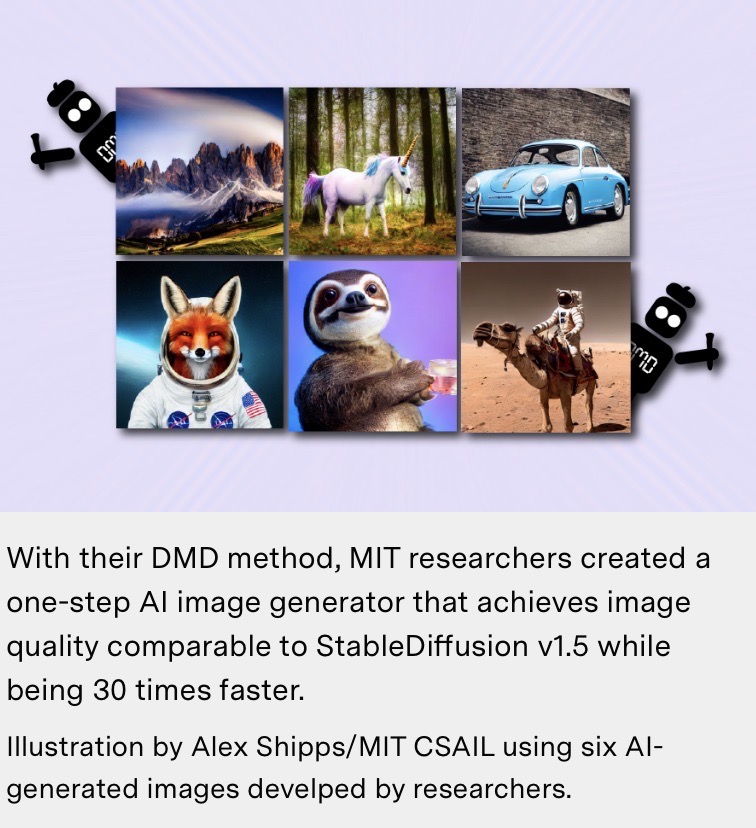

Novel method makes tools like Stable Diffusion and DALL-E-3 faster by simplifying the image-generating process to a single step while maintaining or enhancing image quality.

AI สร้างภาพคุณภาพสูงเร็วขึ้น 30 เท่า ในขั้นตอนเดียว

วิธีการใหม่ทำให้เครื่องมือ เช่น Stable Diffusion และ DALL-E-3 เร็วขึ้นโดยทำให้กระบวนการสร้างภาพง่ายขึ้นในขั้นตอนเดียว ในขณะเดียวกันก็รักษาหรือปรับปรุงคุณภาพของภาพไปด้วย

ในยุคปัจจุบันของปัญญาประดิษฐ์ คอมพิวเตอร์สามารถสร้าง “ศิลปะ” ของตัวเองโดยใช้โมเดลการแพร่กระจาย (diffusion models) โดยเพิ่มโครงสร้างซ้ำๆ ให้กับสถานะเริ่มต้นที่มีสัญญาณรบกวนจนกระทั่งได้ภาพหรือวิดีโอที่ชัดเจน โมเดลการแพร่กระจายจะเป็นที่ต้องการของทุกคน เพียงป้อนคำไม่กี่คำ คุณจะได้สัมผัสประสบการณ์ภาพที่น่าเหลือเชื่อ จุดบรรจบของความเป็นจริงและจินตนาการ เบื้องหลังนั้นเกี่ยวข้องกับกระบวนการที่ซับซ้อนและใช้เวลานานซึ่งต้องใช้การวนซ้ำหลายครั้งเพื่อให้อัลกอริธึมเพื่อทำให้ภาพสมบูรณ์แบบ

นักวิจัยในห้องปฏิบัติการวิทยาการคอมพิวเตอร์และปัญญาประดิษฐ์ (CSAIL) ของ MIT ได้นำเสนอกรอบการทำงานใหม่ที่ทำให้กระบวนการโมเดลการแพร่กระจายแบบหลายขั้นตอนแบบเดิมง่ายขึ้นเป็นขั้นตอนเดียว โดยจัดการกับข้อจำกัดก่อนหน้านี้ ซึ่งทำได้ผ่าน teacher-student model: การสอนโมเดลคอมพิวเตอร์ใหม่เพื่อเลียนแบบพฤติกรรมของโมเดลดั้งเดิมที่ซับซ้อนมากขึ้นซึ่งสร้างภาพ วิธีการนี้เรียกว่าการกลั่นแบบจับคู่การกระจาย distribution matching distillation (DMD) โดยจะรักษาคุณภาพของภาพที่สร้างขึ้นและช่วยให้สร้างภาพได้เร็วยิ่งขึ้นมาก

“งานของเราเป็นวิธีการใหม่ที่ช่วยเร่งโมเดลการแพร่กระจายในปัจจุบัน เช่น Stable Diffusion และ DALLE-3 ได้ถึง 30 เท่า” Tianwei Yin นักศึกษาปริญญาเอกจาก MIT สาขาวิศวกรรมไฟฟ้าและวิทยาการคอมพิวเตอร์ บริษัทในเครือ CSAIL และหัวหน้านักวิจัยด้าน DMD กล่าว กรอบ. “ความก้าวหน้านี้ไม่เพียงแต่ช่วยลดเวลาในการคำนวณลงอย่างมาก แต่ยังรักษาคุณภาพของเนื้อหาภาพที่สร้างขึ้น หากไม่เกินกว่านั้นด้วย ตามทฤษฎี วิธีการดังกล่าวจะผสมผสานหลักการของ generative adversarial networks (GANs) เข้ากับหลักการของโมเดลการแพร่กระจาย ทำให้เกิดการสร้างเนื้อหาภาพในขั้นตอนเดียว ซึ่งแตกต่างอย่างสิ้นเชิงกับขั้นตอนร้อยขั้นตอนของการปรับแต่งซ้ำตามที่กำหนดโดยโมเดลการแพร่กระจายในปัจจุบัน อาจเป็นวิธีการสร้างโมเดลเชิงกำเนิดแบบใหม่ที่มีความเป็นเลิศในด้านความเร็วและคุณภาพ”

โมเดลการแพร่กระจายในขั้นตอนเดียวนี้สามารถปรับปรุงเครื่องมือการออกแบบ ช่วยให้สามารถสร้างเนื้อหาได้เร็วขึ้น และอาจสนับสนุนความก้าวหน้าในการค้นพบยาและการสร้างโมเดล 3 มิติ ซึ่งความรวดเร็วและประสิทธิภาพเป็นกุญแจสำคัญ

การกระจายความฝัน

DMD มีสององค์ประกอบอย่างชาญฉลาด ประการแรก ใช้การสูญเสียการถดถอย ซึ่งยึดการแมปเพื่อให้แน่ใจว่ามีการจัดระเบียบพื้นที่รูปภาพอย่างหยาบเพื่อให้การฝึกอบรมมีเสถียรภาพมากขึ้น ถัดไป ใช้การสูญเสียการจับคู่การแจกแจง ซึ่งช่วยให้มั่นใจว่าความน่าจะเป็นในการสร้างภาพที่กำหนดให้ด้วยโมเดลของนักเรียนนั้นสอดคล้องกับความถี่ในการเกิดในโลกแห่งความเป็นจริง ในการทำเช่นนี้ จะใช้ประโยชน์จากโมเดลการแพร่กระจายสองแบบที่ทำหน้าที่เป็นแนวทาง ช่วยให้ระบบเข้าใจความแตกต่างระหว่างภาพจริงและภาพที่สร้างขึ้น และทำให้การฝึกอบรมเครื่องกำเนิดขั้นตอนเดียวที่รวดเร็วเป็นไปได้

ระบบสร้างความเร็วได้เร็วขึ้นโดยการฝึกอบรมเครือข่ายใหม่เพื่อลดความแตกต่างในการกระจายระหว่างรูปภาพที่สร้างขึ้นและจากชุดข้อมูลการฝึกอบรมที่ใช้โดยโมเดลการแพร่กระจายแบบดั้งเดิม “ข้อมูลเชิงลึกที่สำคัญของเราคือการประมาณการไล่ระดับสีที่เป็นแนวทางในการปรับปรุงโมเดลใหม่โดยใช้โมเดลการแพร่กระจายสองแบบ” Yin กล่าว “ด้วยวิธีนี้ เรากลั่นความรู้เกี่ยวกับโมเดลดั้งเดิมที่ซับซ้อนมากขึ้นให้กลายเป็นโมเดลที่ง่ายกว่าและเร็วกว่า ขณะเดียวกันก็ข้ามปัญหาความไม่เสถียรที่ฉาวโฉ่และการล่มสลายของโหมดใน GAN”

Yin และเพื่อนร่วมงานใช้เครือข่ายที่ได้รับการฝึกอบรมล่วงหน้าสำหรับโมเดลนักเรียนใหม่ ซึ่งทำให้กระบวนการง่ายขึ้น ด้วยการคัดลอกและปรับแต่งพารามิเตอร์จากรุ่นดั้งเดิม ทีมงานประสบความสำเร็จในการฝึกอบรมการผสานรวมโมเดลใหม่อย่างรวดเร็ว ซึ่งสามารถสร้างภาพคุณภาพสูงด้วยรากฐานทางสถาปัตยกรรมเดียวกัน “สิ่งนี้ทำให้สามารถใช้ร่วมกับการปรับแต่งระบบอื่นๆ ตามสถาปัตยกรรมดั้งเดิมเพื่อเร่งกระบวนการสร้างให้เร็วขึ้น” Yin กล่าวเสริม

เมื่อทำการทดสอบกับวิธีปกติโดยใช้เกณฑ์มาตรฐานที่หลากหลาย DMD จะแสดงประสิทธิภาพที่สม่ำเสมอ จากเกณฑ์มาตรฐานยอดนิยมในการสร้างภาพตามคลาสเฉพาะบน ImageNet นั้น DMD เป็นเทคนิคการแพร่กระจายในขั้นตอนเดียวขั้นตอนแรกที่ปั่นภาพออกมาได้ค่อนข้างทัดเทียมกับโมเดลดั้งเดิมและซับซ้อนกว่า โดยให้ระยะเริ่มต้นของ Fréchet ที่ใกล้มาก ( FID) เพียง 0.3 ซึ่งถือว่าน่าประทับใจ เนื่องจาก FID เป็นการตัดสินคุณภาพและความหลากหลายของภาพที่สร้างขึ้น นอกจากนี้ DMD ยังมีความเป็นเลิศในการสร้างข้อความเป็นรูปภาพในระดับอุตสาหกรรม และบรรลุประสิทธิภาพการสร้างขั้นตอนเดียวที่ล้ำสมัย ยังคงมีช่องว่างด้านคุณภาพเล็กน้อยเมื่อจัดการกับแอปพลิเคชันแปลงข้อความเป็นรูปภาพที่ยุ่งยากกว่า ซึ่งบ่งบอกว่ายังมีพื้นที่อีกเล็กน้อยสำหรับการปรับปรุงในภายหลัง

นอกจากนี้ ประสิทธิภาพของอิมเมจที่สร้างโดย DMD ยังเชื่อมโยงโดยเนื้อแท้กับความสามารถของโมเดลผู้สอนที่ใช้ในระหว่างกระบวนการกลั่น ในรูปแบบปัจจุบัน ซึ่งใช้ Stable Diffusion v1.5 เป็นโมเดลครู นักเรียนสืบทอดข้อจำกัดต่างๆ เช่น การแสดงภาพข้อความและใบหน้าเล็กๆ อย่างละเอียด ซึ่งบ่งบอกว่ารูปภาพที่สร้างโดย DMD สามารถปรับปรุงเพิ่มเติมได้ด้วยโมเดลครูขั้นสูงยิ่งขึ้น

“การลดจำนวนการวนซ้ำถือเป็นจอกศักดิ์สิทธิ์ในโมเดลการแพร่กระจายนับตั้งแต่เริ่มก่อตั้ง” Fredo Durand ศาสตราจารย์ด้านวิศวกรรมไฟฟ้าและวิทยาการคอมพิวเตอร์ของ MIT ผู้ตรวจสอบหลักของ CSAIL และผู้เขียนนำรายงานกล่าว “เรารู้สึกตื่นเต้นมากที่สามารถเปิดใช้งานการสร้างภาพในขั้นตอนเดียวได้ในที่สุด ซึ่งจะช่วยลดต้นทุนการประมวลผลและเร่งกระบวนการได้อย่างมาก”

“สุดท้ายแล้ว บทความที่ประสบความสำเร็จในการรวมความเก่งกาจและคุณภาพของภาพสูงของโมเดลการแพร่กระจายเข้ากับประสิทธิภาพแบบเรียลไทม์ของ GAN” Alexei Efros ศาสตราจารย์ด้านวิศวกรรมไฟฟ้าและวิทยาการคอมพิวเตอร์จากมหาวิทยาลัยแคลิฟอร์เนียที่ Berkeley กล่าว ซึ่งไม่เกี่ยวข้องกับเรื่องนี้ ในการศึกษาครั้งนี้ “ฉันคาดหวังว่างานนี้จะเปิดโอกาสที่ยอดเยี่ยมสำหรับการแก้ไขภาพแบบเรียลไทม์คุณภาพสูง”

ผู้ร่วมเขียนของ Yin และ Durand คือศาสตราจารย์ด้านวิศวกรรมไฟฟ้าและวิทยาการคอมพิวเตอร์ของ MIT และ William T. Freeman นักวิจัยหลักของ CSAIL รวมถึงนักวิทยาศาสตร์ด้านการวิจัยของ Adobe Michaël Gharbi SM ’15, PhD ’18; ริชาร์ด จาง; เอไล เชชท์แมน; และแทซองปาร์ค งานของพวกเขาได้รับการสนับสนุนบางส่วนจากทุนสนับสนุนของมูลนิธิวิทยาศาสตร์แห่งชาติของสหรัฐอเมริกา (รวมถึงทุนสำหรับ the Institute for Artificial Intelligence and Fundamental Interactions) สำนักงานวิทยาศาสตร์และเทคโนโลยีกลาโหมของสิงคโปร์ และโดยการระดมทุนจากสถาบันวิทยาศาสตร์และเทคโนโลยีกวางจูและอเมซอน ผลงานของพวกเขาจะถูกนำเสนอในการประชุมเรื่อง Computer Vision and Pattern Recognition ในเดือนมิถุนายน