Microsoft ได้ประกาศเปิดตัวโมเดลภาษาขนาดเล็กแบบเปิด (SLM) ในตระกูล Phi-3 โดยระบุว่าเป็นโมเดลที่มีความสามารถและคุ้มค่าที่สุดจากขนาดที่มีอยู่ แนวทางการฝึกอบรมเชิงนวัตกรรมที่พัฒนาโดยนักวิจัยของ Microsoft ช่วยให้โมเดล Phi-3 มีประสิทธิภาพเหนือกว่าโมเดลขนาดใหญ่ในด้านการวัดประสิทธิภาพด้านภาษา การเขียนโค้ด และคณิตศาสตร์

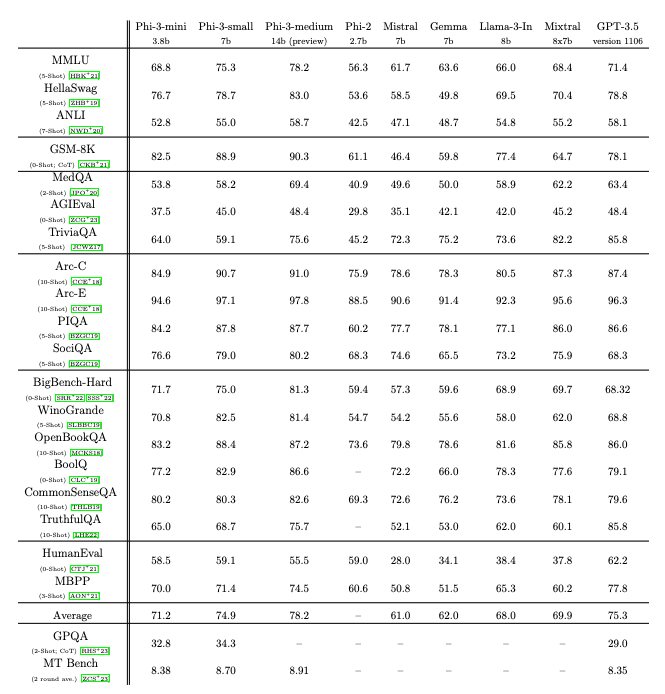

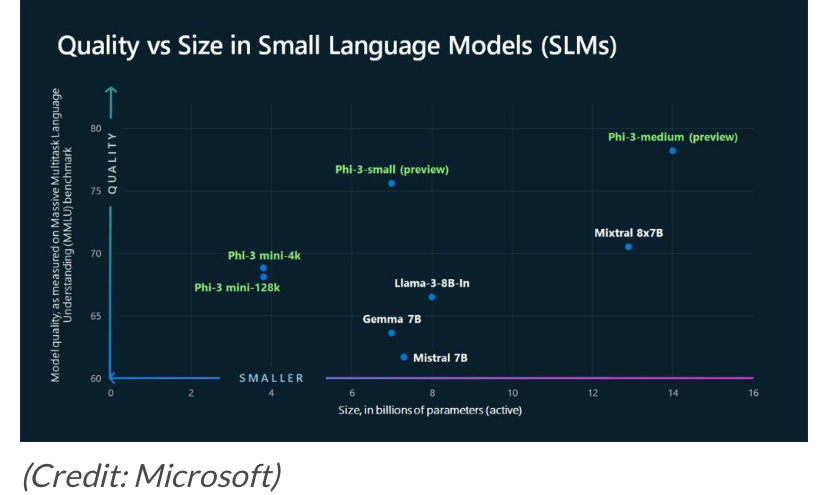

Microsoft has announced the Phi-3 family of open small language models (SLMs), touting them as the most capable and cost-effective of their size available. The innovative training approach developed by Microsoft researchers has allowed the Phi-3 models to outperform larger models on language, coding, and math benchmarks.

Microsoft เปิดตัวโมเดลภาษาขนาดกะทัดรัดตระกูล Phi-3

Microsoft ได้ประกาศเปิดตัวโมเดลภาษาขนาดเล็กแบบเปิด (SLM) ในตระกูล Phi-3 โดยระบุว่าเป็นโมเดลที่มีความสามารถและคุ้มค่าที่สุดจากขนาดที่มีอยู่ แนวทางการฝึกอบรมเชิงนวัตกรรมที่พัฒนาโดยนักวิจัยของ Microsoft ช่วยให้โมเดล Phi-3 มีประสิทธิภาพเหนือกว่าโมเดลขนาดใหญ่ในด้านการวัดประสิทธิภาพด้านภาษา การเขียนโค้ด และคณิตศาสตร์

“สิ่งที่เราจะเริ่มเห็นไม่ใช่การเปลี่ยนจากรุ่นใหญ่ไปรุ่นเล็ก แต่เป็นการเปลี่ยนจากรุ่นประเภทเดียวไปเป็นรุ่นต่างๆ ที่ลูกค้าสามารถตัดสินใจได้ว่ารุ่นใดดีที่สุดสำหรับพวกเขา สถานการณ์” Sonali Yadav ผู้จัดการผลิตภัณฑ์หลักสำหรับ Generative AI ของ Microsoft กล่าว

Phi-3 รุ่นแรก Phi-3-mini ที่ 3.8 พันล้านพารามิเตอร์ พร้อมใช้งานแล้วใน Azure AI Model Catalog, Hugging Face, Ollama และในฐานะไมโครเซอร์วิสของ NVIDIA NIM แม้จะมีขนาดกะทัดรัด แต่ Phi-3-mini ก็มีประสิทธิภาพเหนือกว่ารุ่นที่มีขนาดเป็นสองเท่า โมเดล Phi-3 เพิ่มเติม เช่น Phi-3-small (พารามิเตอร์ 7B) และ Phi-3-medium (พารามิเตอร์ 14B) จะตามมาเร็วๆ นี้

“ลูกค้าบางรายอาจต้องการโมเดลรุ่นเล็ก บางคนต้องการโมเดลรุ่นใหญ่ และอีกหลายคนต้องการรวมทั้งสองอย่างเข้าด้วยกันในหลากหลายวิธี” Luis Vargas รองประธานฝ่าย AI ของ Microsoft กล่าว

ข้อได้เปรียบที่สำคัญของ SLM คือขนาดที่เล็กกว่าทำให้สามารถปรับใช้บนอุปกรณ์เพื่อประสบการณ์ AI ที่มีความหน่วงต่ำโดยไม่ต้องเชื่อมต่อเครือข่าย กรณีการใช้งานที่เป็นไปได้ ได้แก่ เซ็นเซอร์อัจฉริยะ กล้อง อุปกรณ์การเกษตร และอื่นๆ ความเป็นส่วนตัวเป็นอีกหนึ่งข้อดีของการเก็บข้อมูลไว้ในอุปกรณ์

โมเดลภาษาขนาดใหญ่ (LLM) เก่งในเรื่องการให้เหตุผลที่ซับซ้อนบนชุดข้อมูลขนาดใหญ่ ซึ่งเป็นจุดแข็งที่เหมาะกับการใช้งาน เช่น การค้นคว้าด้านยารักษาโรค โดยการทำความเข้าใจปฏิสัมพันธ์ในวรรณกรรมทางวิทยาศาสตร์ อย่างไรก็ตาม SLM เสนอทางเลือกที่น่าสนใจสำหรับการตอบแบบสอบถาม การสรุป การสร้างเนื้อหา และอื่นๆ ที่คล้ายคลึงกันที่ง่ายกว่า

“แทนที่จะไล่ตามโมเดลที่ใหญ่กว่า Microsoft กำลังพัฒนาเครื่องมือที่มีข้อมูลที่รวบรวมไว้อย่างรอบคอบและการฝึกอบรมเฉพาะทาง” Victor Botev, CTO และผู้ร่วมก่อตั้ง Iris.ai ให้ความเห็น

“สิ่งนี้ช่วยให้ประสิทธิภาพดีขึ้นและความสามารถในการให้เหตุผลโดยไม่ต้องเสียค่าใช้จ่ายในการคำนวณจำนวนมากของโมเดลที่มีพารามิเตอร์หลายล้านล้านรายการ การปฏิบัติตามแนวคิดนี้จะหมายถึงการทลายกำแพงสำหรับธุรกิจที่กำลังมองหาโซลูชัน AI”

เทคนิคการฝึกอบรมที่ก้าวล้ำ

สิ่งที่เปิดใช้งานการก้าวกระโดดด้านคุณภาพ SLM ของ Microsoft คือ การกรองข้อมูล ที่เป็นนวัตกรรมและแนวทางการสร้างที่ได้รับแรงบันดาลใจจากหนังสือนิทานก่อนนอน

“แทนที่จะฝึกอบรมโมเดล ด้วยดาต้าเซ็ตที่กวาดมาจากข้อมูลทั้งหมดในเว็บ ทำไมคุณไม่มองหาข้อมูลที่มีคุณภาพสูงสุดล่ะ” Sebastien Bubeck รองประธานฝ่ายวิจัย SLM ของ Microsoft ตั้งคำถาม

กิจวัตรการอ่านหนังสือทุกคืนของ Ronen Eldan กับลูกสาวได้จุดประกายความคิดที่จะสร้างชุดข้อมูล “TinyStories” ซึ่งประกอบด้วยเรื่องราวที่เรียบง่ายหลายล้านเรื่อง ที่สร้างขึ้นโดยการสร้างแบบจำลองขนาดใหญ่ที่มีการผสมผสานคำที่เด็กอายุ 4 ขวบน่าจะรู้จัก น่าสังเกตที่โมเดลพารามิเตอร์ 10M ที่ได้รับการฝึกบน TinyStories สามารถสร้างเรื่องราวได้อย่างคล่องแคล่วและมีไวยากรณ์ที่สมบูรณ์แบบ

จากความสำเร็จในช่วงแรกนั้น ทีมงานได้จัดหาข้อมูลเว็บคุณภาพสูงที่ผ่านการคัดเลือกเพื่อคุณค่าทางการศึกษาเพื่อสร้างชุดข้อมูล ‘CodeTextbook’ สิ่งนี้ถูกสังเคราะห์ผ่านรอบการกระตุ้น การสร้าง และการกรองโดยทั้งมนุษย์ และโมเดล AI ขนาดใหญ่

“เราใส่ใจอย่างมากในการผลิตข้อมูลสังเคราะห์เหล่านี้” Bubeck กล่าว “เราไม่เอาทุกสิ่งที่เราหาได้”

ข้อมูลการฝึกอบรมคุณภาพสูงได้รับการพิสูจน์แล้วว่าสามารถเปลี่ยนแปลงได้ “เนื่องจากเป็นการอ่านจากเนื้อหาที่คล้ายกับตำราเรียน… คุณทำให้งานของโมเดลภาษาอ่านและเข้าใจเนื้อหานี้ได้ง่ายขึ้นมาก” Bubeck อธิบาย

การลดความเสี่ยงด้านความปลอดภัยของ AI

แม้จะมีการดูแลจัดการข้อมูลที่รอบคอบ แต่ Microsoft ก็เน้นย้ำถึงการนำแนวทางปฏิบัติด้านความปลอดภัยเพิ่มเติมมาใช้กับ Phi-3 ซึ่งสะท้อนกระบวนการมาตรฐานสำหรับโมเดล generative AI ทั้งหมด

“เช่นเดียวกับการเปิดตัวโมเดล AI ทั้งหมด ผลิตภัณฑ์ของ Microsoft และทีม AI ที่รับผิดชอบใช้วิธีการแบบหลายชั้นในการจัดการและลดความเสี่ยงในการพัฒนาโมเดล Phi-3” โพสต์ในบล็อกระบุ

ซึ่งรวมถึงตัวอย่างการฝึกอบรมเพิ่มเติมเพื่อเสริมพฤติกรรมที่คาดหวัง การประเมินเพื่อระบุช่องโหว่ผ่านทีมงาน red-teaming และการนำเสนอเครื่องมือ Azure AI สำหรับลูกค้าเพื่อสร้างแอปพลิเคชันที่น่าเชื่อถือบน Phi-3